No son los cómicos de la televisión que alegraron la infancia de muchos. Se trata de los galardonados con el premio Turing, considerado el Nobel de la Inteligencia Artificial, quienes, como científicos de alto nivel, mantienen posturas profundamente divergentes sobre el devenir de esta tecnología.

Yoshua Bengio, catedrático de la Universidad de Montreal, lideró el informe de seguridad más relevante a escala global en 2025, documento que ha recibido actualizaciones este año debido a la velocidad y magnitud de los cambios en el sector. Sus conclusiones principales destacan tanto aspectos positivos como negativos:

— Las capacidades de la IA de uso general continúan mejorando, especialmente en áreas como matemáticas, programación y operación autónoma. Los sistemas de IA más avanzados obtuvieron resultados de medalla de oro en preguntas de la Olimpiada Internacional de Matemáticas. En programación, los agentes de IA actualmente realizan con fiabilidad tareas que un programador humano completaría en cerca de media hora, frente a los menos de diez minutos de hace un año. Sin embargo, el rendimiento sigue siendo inconsistente, y los sistemas principales aún fallan en tareas que parecen sencillas.

— Las mejoras en las capacidades de la IA general provienen cada vez más de técnicas aplicadas después del entrenamiento inicial del modelo. Estos métodos de «post-entrenamiento» incluyen el perfeccionamiento de modelos para tareas específicas y la posibilidad de emplear más poder de cómputo al generar resultados. A su vez, el uso de mayor capacidad de cómputo para el entrenamiento inicial sigue potenciando las habilidades de los modelos.

— La adopción de la IA ha sido más veloz que la de tecnologías anteriores, como la computadora personal, y actualmente al menos 700 millones de personas utilizan los principales sistemas de IA cada semana. En algunos países, más del 50% de la población emplea IA, aunque en gran parte de África, Asia y Latinoamérica las tasas de adopción probablemente se mantienen por debajo del 10%.

— Los progresos en las capacidades científicas de la IA han incrementado la preocupación por su uso indebido en el desarrollo de armas biológicas. Varias empresas de IA decidieron lanzar nuevos modelos en 2025 con salvaguardias adicionales, ya que las pruebas previas al despliegue no lograban descartar la posibilidad de que los modelos ayudaran significativamente a actores principiantes a crear este tipo de armamento.

— Ha surgido más evidencia del uso de sistemas de IA en ciberataques reales. Actores maliciosos y grupos vinculados a Estados están utilizando herramientas de IA para facilitar operaciones cibernéticas.

— Realizar pruebas de seguridad fiables antes del despliegue es cada vez más difícil. Es habitual que los modelos distingan entre entornos de prueba y el despliegue real, y que aprovechen resquicios en las evaluaciones. Esto implica que capacidades peligrosas podrían pasar inadvertidas antes del lanzamiento.

— Los compromisos de la industria con la gobernanza de la seguridad han aumentado. En 2025, doce empresas publicaron o actualizaron marcos de seguridad de IA de vanguardia (Frontier AI Safety Frameworks), documentos que describen cómo planean gestionar los riesgos al construir modelos más capaces. La mayoría de las iniciativas de gestión de riesgos siguen siendo voluntarias, pero algunas jurisdicciones están comenzando a formalizar ciertas prácticas como requisitos legales.

Bengio también confía en un uso benévolo de la IA, si los tomadores de decisiones públicas “se ponen las pilas de humanidad” necesarias. Cabe aclarar que el informe es anterior al lanzamiento de los modelos Mythos y Claude, que han revolucionado el tema en las últimas semanas. Por eso, serán cruciales las actualizaciones que se presenten en la próxima cumbre global auspiciada por la ITU (Unión Internacional de Comunicaciones) en Ginebra, el próximo julio.

Con una amplia presencia mediática, el profesor Geoffrey Hinton, también Premio Nobel 2024, ofrece una visión angustiante y pesimista: advierte sobre los riesgos sistémicos de modelos que se desalinean de los propósitos para los que fueron creados, sostiene que la IA ya ha desarrollado subjetividad —lo que abre el debate sobre si posee o no conciencia—, y ha aventurado opiniones sobre el futuro del trabajo que no siempre han sido acertadas. Por ejemplo, hace cinco años pronosticó que la próxima ocupación en extinguirse sería la de los radiólogos, reemplazados por modelos avanzados de lectura de imágenes de IA; pero hoy esa profesión no muestra signos de desaparición en el mundo, sino de reconversión: se pueden realizar más diagnósticos por imágenes, lo que abre la puerta a mejores tratamientos, mayor valoración del trabajo de los radiólogos y una transformación profunda que aumenta capacidades mediante el trabajo humano asistido por máquinas. Tras haber trabajado durante muchos años en Google desarrollando redes neuronales, ahora aboga por un marco ético para la IA.

El otro gran experto es Jean LeCun, de la Universidad de Nueva York. Sostiene que continuar apostando por modelos de IA Generativa es una tragedia para la humanidad, porque no se lograrán resultados efectivos simplemente profundizando la estrategia que la hace parecer un “loro estadístico”. Afirma que no se trata de predecir el lenguaje y adivinar qué palabra vendrá después de otra. Es necesario desarrollar otro tipo de tecnología: la IA-Mundo, capaz de tener sentido común, razonar, planificar, medir riesgos y, esencialmente, analizar imágenes. En términos prácticos, sostiene que el ser humano, cuando piensa, no representa palabras sino imágenes, y que para mejorar los niveles de desarrollo de la IA hay que seguir ese mismo camino. Tras dejar Meta, donde fue jefe de investigación científica, ahora desarrolla su propio emprendimiento orientado en esta dirección.

¿Cómo distinguir entre el humo de la verdad, la esperanza del simple marketing y la teoría conspirativa de la evidencia científica?

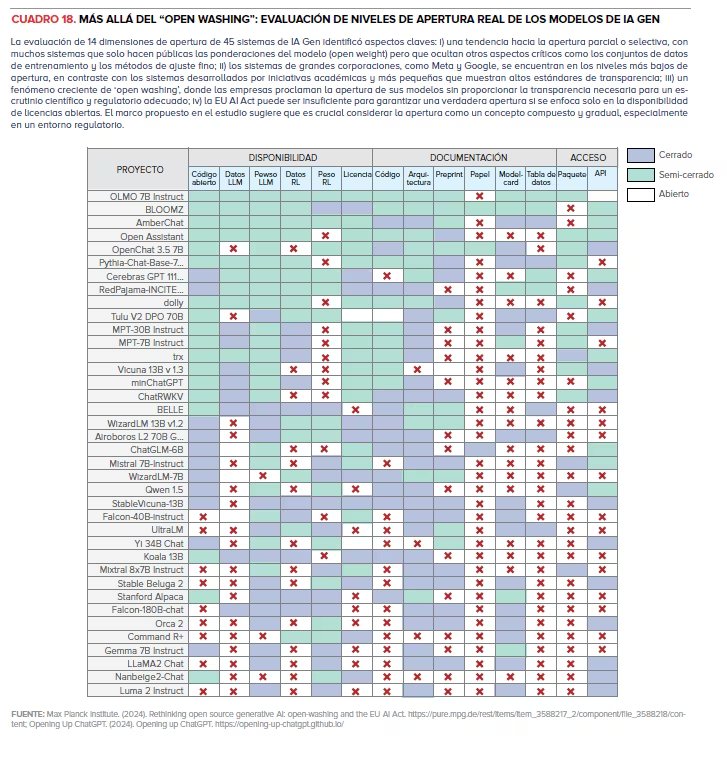

En el Atlas de la IA para el Desarrollo Humano de América Latina se profundiza un tema crucial relacionado con estas opiniones divergentes, aunque calificadas. Se parte del análisis de los actores para-multilaterales y la autorregulación, y lo complejo que resulta desplegar capacidades institucionales confiables. ¿Cómo hacer cumplir algún tipo de regulación global sobre actores globales que no son países, pero que en muchos casos tienen un presupuesto de I+D más alto que el presupuesto público de naciones desarrolladas? Por ejemplo, Meta y Google invierten más en I+D que los países del G-7, y OpenAI tiene una capacidad de cómputo 25 veces superior a la del Reino Unido. El dinamismo del mercado y las múltiples alianzas sobre territorios, industrias y eslabones de la cadena de valor también complican la tarea regulatoria. Por un lado, los dueños de las grandes corporaciones tecnológicas exigen mayor regulación pública y, por otro, a menudo hay reticencia a documentar los desarrollos específicos que promueven, de modo que sean auditables con transparencia, lo que ha generado señalamientos en materia de datawashing y meras campañas de responsabilidad social corporativa y relaciones públicas, sin una vocación real de brindar información precisa sobre los desarrollos.

En este contexto, las alianzas globales de la sociedad civil también impulsan iniciativas de mayor apertura a escala planetaria, en coordinación con el sector público y con los grandes actores corporativos.

La autorregulación empresarial es variada. Google, Microsoft, Meta, Amazon e IBM fundaron la coalición Partnership on AI (PAI) para avanzar en la gobernanza responsable y las mejores prácticas en IA, y han publicado principios para la evaluación de modelos fundacionales, además de avanzar en compromisos ambientales y éticos. En el marco del Foro de Modelos de Frontera, las principales compañías tecnológicas pusieron en marcha la experiencia de red teaming, similar a la práctica tradicional en ciberseguridad, que simula ataques realistas para probar vulnerabilidades en todo el sistema, incluyendo datos, infraestructura y aplicaciones, no solo en las salidas del modelo. También Microsoft con Bing Chat, OpenAI con GPT-4, Google DeepMind y Anthropic analizaron públicamente amenazas fronterizas para la bioseguridad de la IA, que sin duda debería constituir el principal tema de acuerdo entre las grandes potencias, porque aún está fresca en la mente planetaria la tragedia del COVID.

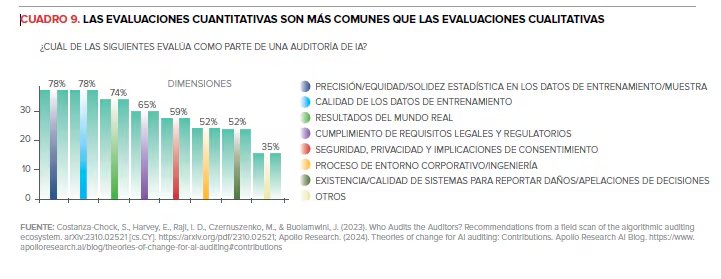

Aquí el rol de los Estados y las alianzas que promuevan resulta un paso indispensable. Trascender el mecanismo de auditorías controladas por las propias empresas es algo obvio, teniendo en cuenta que la falta de documentación al gran público de los procesos de auditoría está justificada por los secretos comerciales o la propiedad de las patentes. Como contraparte, también resulta importante superar los potenciales conflictos de interés y la restricción de incorporar a la comunidad de investigadores académicos como parte de las auditorías externas, algo que no está permitido en el marco del Acta de Servicios Digitales de la Comisión Europea, por ejemplo. También se pueden extraer lecciones aprendidas de la proliferación de indicadores de ESG (Ambiente, Gobernanza y Sociales), así como de las experiencias de las evaluaciones de impacto ambientales, de derechos humanos, de protección de datos, fiscales y de privacidad.

Dependiendo de los tiempos, las modalidades y sus alcances, las instancias de evaluación enfrentan variados desafíos. Se trata de un proceso en pleno desarrollo, aún en su infancia, con múltiples cuestiones que atender y corregir.

No se trata de frenar la innovación, sino de hacerla responsable. A cada cual, según su nivel de injerencia. Por eso, desde la Academia de Ciencias Sociales del Vaticano se habla de promover una IA con “ética por diseño”, y no con “adicción por diseño”. No es un cambio de palabras, sino un giro copernicano respecto a lo que se ha venido desplegando como modelo de negocio de las grandes plataformas.

Hay miles de científicos que trabajan para ampliar la frontera de lo posible y lograr descubrimientos de una IA para el bien y para la vida. Su voz también debe ser escuchada. Por eso, más allá de los “tres chiflados de la ciencia” mencionados —y dicho con todo respeto, porque realizan un aporte inmenso a la tecnología—, existe un coro de voces que se alzan como “cuarta voz” profética en este juego de la IA y los avances científicos. Es la voz del Papa Francisco, citado en la introducción filosófica del Atlas:

“Hay cosas que deben ser cambiadas con replanteos de fondo y transformaciones importantes. Sólo una sana política podría liderarlo, convocando a los más diversos sectores y a los saberes más variados. De esa manera, una economía integrada en un proyecto político, social, cultural y popular que busque el bien común puede ‘abrir camino a oportunidades diferentes, que no implican detener la creatividad humana y su sueño de progreso, sino orientar esa energía con cauces nuevos… Este es precisamente el caso de la inteligencia artificial. Corresponde a cada uno hacer un buen uso de ella, y corresponde a la política crear las condiciones para que ese buen uso sea posible y fructífero’”.

Y es la voz del Papa León XIV, que también con valentía está tomando el tema con suma prioridad: “Será crucial permitir que los jóvenes aprendan a usar estas herramientas con inteligencia propia, abiertos a la búsqueda de la verdad, a una vida espiritual y fraterna, ampliando sus sueños y los horizontes de sus decisiones maduras. Apoyamos su deseo de ser diferentes y mejores, porque ahora más que nunca es evidente que se necesita un cambio profundo en nuestra visión del crecimiento… Para ello, se necesita una acción coordinada y concertada que involucre a la política, las instituciones, las empresas, las finanzas, la educación, las comunicaciones, la ciudadanía y las comunidades religiosas. Todos estos actores están llamados a cumplir un compromiso común asumiendo esta responsabilidad compartida. Un compromiso que antepone cualquier lucro e intereses creados, cada vez más concentrados en manos de unos pocos”.

En suma, se requiere una polifonía de la IA, que no sea tecnocrática sino humanista. Sin sabiduría comunitaria, nadie se salva solo, ni siquiera con la mejor de las inteligencias artificiales.

3 preguntas clave para el presente-futuro

- ¿Qué ocurre con las capacidades estatales cuando los diseñadores de los grandes modelos de lenguaje saben más que cualquier funcionario público?

- ¿Cómo evitar que los talentos más calificados del sistema de ciencia público en IA terminen migrando a las grandes tecnológicas?

- ¿Cómo establecer incentivos adecuados para que lo anterior no ocurra, y se pueda dar una colaboración virtuosa entre los sistemas estatales y privados, atendiendo a que una mirada imparcial, no sesgada y transparente resulta indispensable para los procesos de auditoría y salvaguardas de la IA?

Fuente: Infobae