Escuchar parece una acción automática hasta que el entorno se llena de voces, música, platos, motores y conversaciones cruzadas. En un restaurante concurrido, una reunión familiar o una oficina ruidosa, millones de personas con problemas auditivos enfrentan una dificultad cotidiana: entender qué dice alguien sin que todos los sonidos alrededor se mezclen en un murmullo imposible de separar.

Ahora, un grupo de investigadores de Columbia University logró demostrar por primera vez en humanos una tecnología capaz de hacer algo que parecía ciencia ficción: identificar, a partir de la actividad cerebral, qué voz intenta seguir una persona en medio de múltiples conversaciones y amplificar únicamente esa señal.

El avance, publicado en la revista Nature Neuroscience por científicos del Zuckerman Institute, representa un paso importante hacia una nueva generación de dispositivos auditivos inspirados en el funcionamiento natural del cerebro.

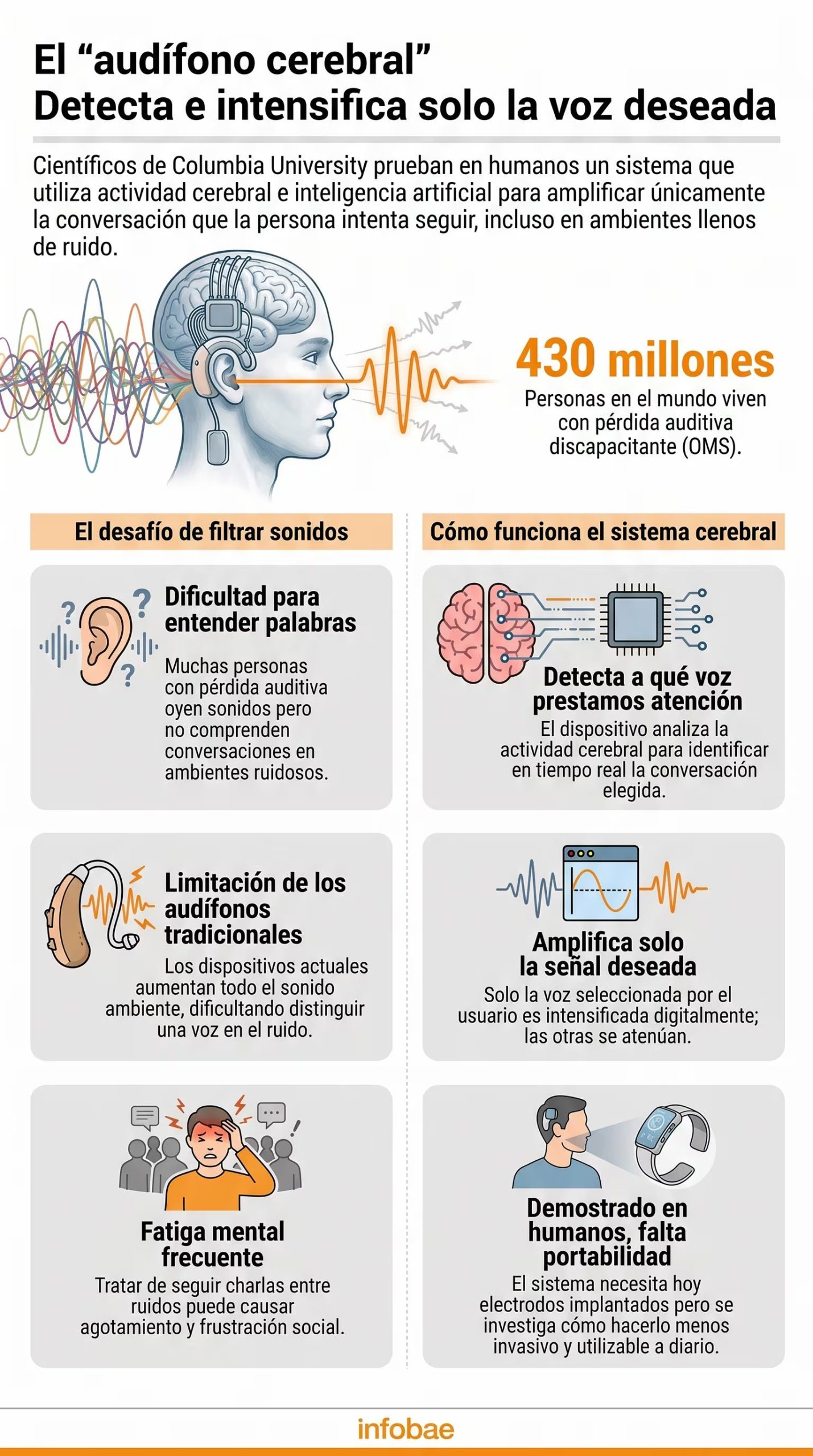

A diferencia de los audífonos tradicionales, que aumentan el volumen de todo lo que captan, este sistema intenta reproducir la habilidad del sistema nervioso humano de enfocarse en una sola conversación mientras el resto del entorno queda en segundo plano.

La limitación central de los audífonos convencionales

Muchas personas con pérdida auditiva pueden escuchar sonidos, pero no comprenden palabras cuando hay ruido alrededor. Este fenómeno se conoce como efecto cóctel, en alusión a la capacidad de concentrarse en una sola voz en una fiesta o reunión con múltiples hablantes.

Para el cerebro humano sano, este filtrado ocurre de forma automática. Sin embargo, esa capacidad suele deteriorarse con la pérdida auditiva y con el envejecimiento.

Los audífonos convencionales amplifican indiscriminadamente el sonido ambiente, por lo que la voz deseada compite con conversaciones cercanas, cubiertos, televisores, tráfico o música de fondo. El resultado puede ser una fatiga mental intensa tras intentar seguir conversaciones en ambientes concurridos.

Cómo funciona el “audífono cerebral”

La nueva tecnología desarrollada en Columbia utiliza inteligencia artificial y señales neuronales para resolver ese problema. El sistema analiza la actividad cerebral en tiempo real para detectar a qué conversación presta atención el usuario. Una vez identificada esa voz, la amplifica digitalmente mientras atenúa las demás. En lugar de decidir qué sonido aumentar, el dispositivo “lee” la intención auditiva del cerebro.

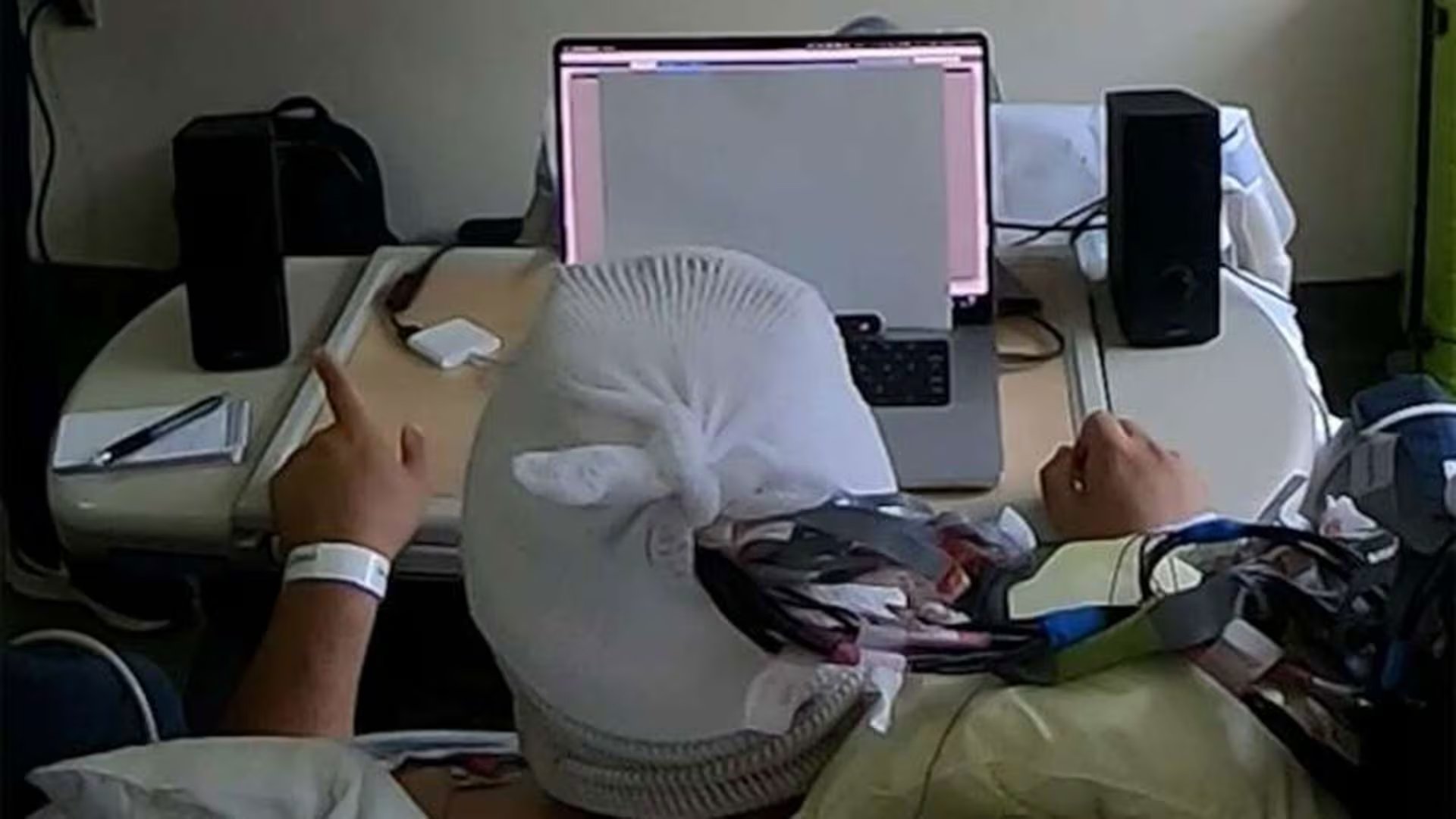

Para probarlo, los investigadores trabajaron con pacientes con epilepsia que ya tenían electrodos implantados —pequeños sensores que registran la actividad eléctrica de las neuronas— como parte de tratamientos previos. Los participantes colaboraron voluntariamente en hospitales de Nueva York y California.

Durante las pruebas, escuchaban dos conversaciones superpuestas mientras el sistema monitoreaba la actividad neuronal asociada a la atención. Los resultados mostraron que el dispositivo reconocía correctamente cuál de las voces intentaba seguir cada participante y potenciaba solo esa conversación.

“Desarrollamos un sistema que actúa como una extensión neural del usuario”, explicó Nima Mesgarani, investigador principal del proyecto. Según detalló, la tecnología aprovecha la capacidad natural del cerebro para filtrar sonidos complejos y aislar la conversación deseada.

La respuesta de los pacientes durante las pruebas

Una paciente llegó a pensar que los investigadores manipulaban manualmente el volumen desde otra habitación porque el cambio entre voces resultaba demasiado exacto. Otra describió la experiencia como “parecido a la ciencia ficción”.

Detrás de esa reacción hay una razón importante: el sistema responde prácticamente en tiempo real. Esa velocidad es clave para que la experiencia resulte natural y no genere retrasos incómodos durante una conversación. El investigador explicó que el sistema funciona tanto cuando el usuario recibe una indicación específica sobre qué conversación seguir como cuando cambia espontáneamente el foco de atención, algo más parecido a la vida cotidiana.

Qué ocurre en el cerebro cuando intentamos escuchar una sola voz

Aunque muchas veces pasa desapercibido, escuchar es una tarea cerebral extremadamente compleja. Cuando varias personas hablan al mismo tiempo, el oído capta todas las ondas sonoras mezcladas. La separación real ocurre después, dentro del cerebro. Regiones especializadas del sistema auditivo analizan patrones diminutos de frecuencia, ritmo y entonación para reconstruir cada voz por separado. Luego, áreas vinculadas con la atención determinan qué conversación priorizar.

Es un proceso tan rápido que normalmente sucede sin esfuerzo consciente. El nuevo dispositivo intenta aprovechar esas señales cerebrales asociadas a la atención selectiva. En otras palabras, detecta cómo responde el cerebro cuando intenta concentrarse en alguien específico.

La Organización Mundial de la Salud (OMS) estima que más de 430 millones de personas viven con pérdida auditiva discapacitante en el mundo. Para muchas, el problema no es el silencio absoluto, sino la dificultad para comunicarse en lugares con ruido. Ese desafío puede generar aislamiento social, frustración e incluso agotamiento emocional. Algunas personas evitan reuniones, restaurantes o encuentros familiares porque seguir conversaciones se vuelve demasiado demandante.

Los investigadores creen que esta tecnología podría cambiar radicalmente esa experiencia. Incluso podría beneficiar a personas sin pérdida auditiva, ayudándolas a reducir el esfuerzo mental en ambientes ruidosos como oficinas abiertas, aeropuertos o eventos masivos.

El desafío ahora es volver la tecnología portátil

Aunque los resultados son prometedores, el sistema aún está lejos de convertirse en un producto comercial. Actualmente depende de electrodos implantados directamente en el cerebro, algo solo posible porque los pacientes ya los utilizaban por motivos médicos.

El próximo objetivo será desarrollar sensores mucho menos invasivos y miniaturizar toda la tecnología para adaptarla a dispositivos utilizables en la vida diaria. Los investigadores también deberán comprobar que el sistema funciona en escenarios reales más complejos, con movimientos, cambios constantes de interlocutores y distintos niveles de ruido. Aun así, el avance representa una demostración inédita de que la actividad cerebral puede utilizarse para mejorar la escucha selectiva humana en tiempo real.

Fuente: Infobae