El avance de la inteligencia artificial ha abierto una nueva frontera para la ciberdelincuencia. Ahora, con apenas unos segundos de audio o un video de redes sociales, los estafadores pueden clonar la voz y el rostro de cualquier persona para perpetrar robos millonarios. Firmas de seguridad como ESET advierten que estas técnicas, antes exclusivas de laboratorios, hoy están al alcance de cualquiera a través de aplicaciones gratuitas.

La facilidad para suplantar identidades es una de las principales preocupaciones de las autoridades. Un mensaje de voz de WhatsApp, un video en redes sociales o una llamada grabada son suficientes para entrenar sistemas que imitan con precisión la forma de hablar de una persona, incluyendo tono, pausas y muletillas. Este fenómeno ya genera pérdidas millonarias globalmente, y organismos como Interpol reportan que redes criminales usan estas herramientas para multiplicar sus ataques.

El mecanismo detrás del clonaje de voz

La clonación de voz se ha convertido en una de las armas predilectas de los ciberdelincuentes. Los sistemas actuales requieren solo unos segundos de grabación para recrear el patrón vocal de un individuo. El resultado es tan convincente que una víctima puede recibir una llamada de un supuesto familiar, amigo o jefe solicitando una transferencia urgente de dinero o datos confidenciales.

La sofisticación ha llegado al punto de que muchos modelos operan en tiempo real. Esto permite al sistema responder preguntas, mantener una conversación fluida y adaptar el tono emocional durante la llamada, haciendo casi imposible detectar el engaño.

De acuerdo con especialistas de Kaspersky, la combinación de inteligencia artificial con manipulación psicológica está posicionando a estos fraudes como uno de los peligros digitales más graves de la actualidad.

Deepfakes en videollamadas: un riesgo creciente

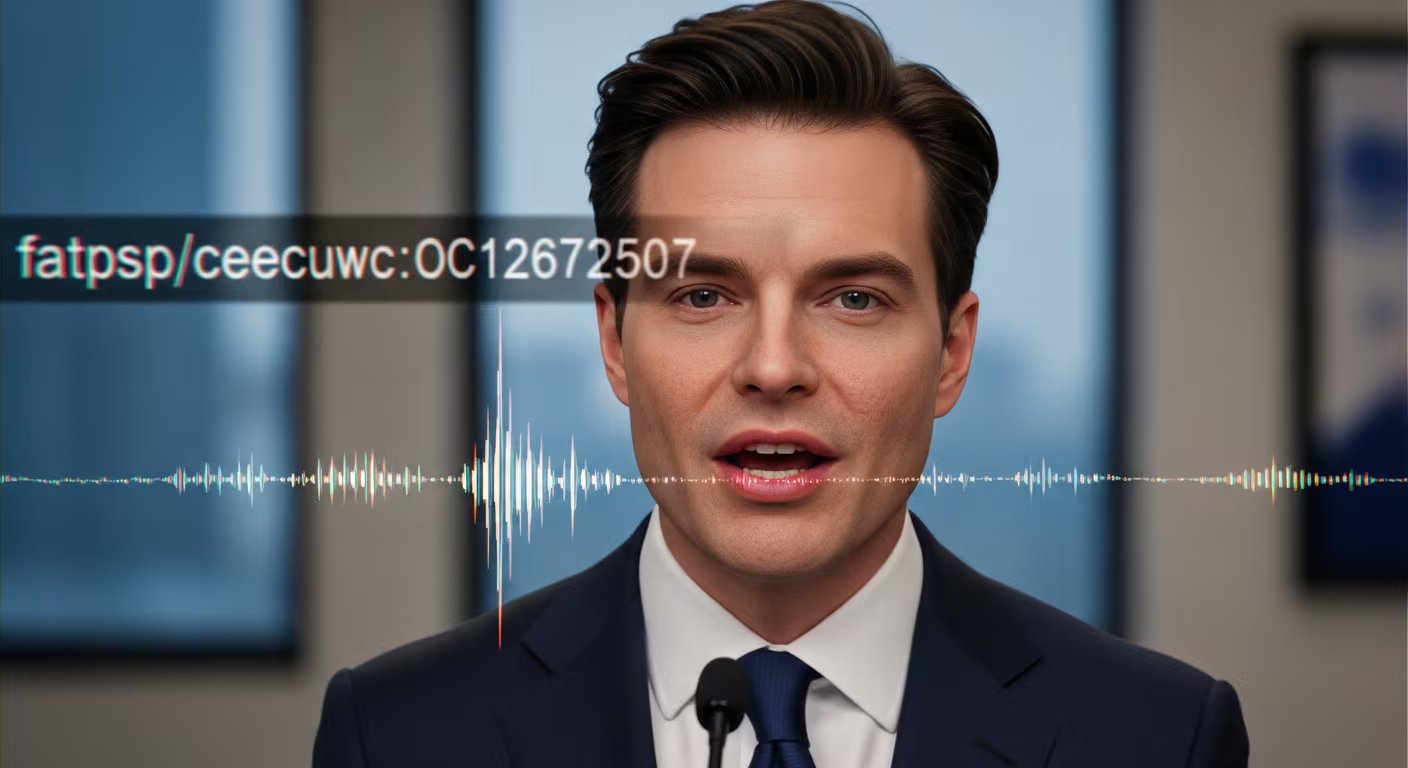

La amenaza no se limita al audio. Los videos deepfake generados por IA también experimentaron un crecimiento explosivo en los últimos años. Empresas de ciberseguridad reportaron un aumento drástico de incidentes con videos falsos durante 2025, impulsado por herramientas cada vez más accesibles.

Un caso emblemático ocurrió en Hong Kong. Un empleado de la firma de ingeniería Arup participó en una videollamada donde creyó estar hablando con directivos reales, incluido el director financiero. Sin embargo, todas las personas en pantalla eran recreaciones de inteligencia artificial. Siguiendo instrucciones que parecían legítimas, el trabajador autorizó transferencias millonarias antes de descubrir el fraude.

Este caso demostró que los deepfakes ya no son videos editados, sino sistemas capaces de simular expresiones faciales, movimientos y diálogos en vivo.

Estafas románticas potenciadas por IA

El fraude romántico también se transformó con la inteligencia artificial. Los expertos denominan a esta nueva modalidad como «pig butchering 2.0», una evolución de las estafas sentimentales clásicas donde se convence a las víctimas para que inviertan en plataformas fraudulentas.

La gran diferencia es que los delincuentes ahora pueden aparecer en videollamadas con rostros creados por IA, interactuar en tiempo real y construir vínculos emocionales mucho más creíbles. Las pérdidas económicas asociadas a este tipo de fraude alcanzan cifras multimillonarias a nivel global, y las personas mayores figuran entre los grupos más vulnerables, con un incremento significativo de casos reportados.

El phishing se vuelve indetectable

La inteligencia artificial también revolucionó los correos de phishing. Antes, los mensajes fraudulentos solían tener errores ortográficos o traducciones pobres. Ahora, los modelos de lenguaje generan textos casi indistinguibles de los comunicados oficiales de bancos, empresas tecnológicas o entidades gubernamentales, lo que dificulta su detección incluso para usuarios avanzados.

La preocupación de los expertos

Lo que más inquieta a los especialistas es que clonar voces o crear deepfakes ya no es costoso ni complejo. Existen aplicaciones gratuitas y herramientas en línea que permiten hacerlo en minutos. Además, en foros clandestinos se venden kits completos para generar identidades falsas, videos manipulados y campañas de fraude automatizadas.

La expansión de estas tecnologías hace que las estafas digitales sean cada vez más difíciles de identificar. Para los expertos, el reto principal es desarrollar mecanismos de verificación y programas de educación digital que avancen al mismo ritmo que la inteligencia artificial.

Fuente: Infobae