La empresa OpenAI ha incorporado una nueva herramienta de seguridad en ChatGPT que permite a los usuarios nombrar a una persona de confianza —ya sea un amigo, familiar o cuidador— para que reciba una alerta cuando el asistente detecte posibles intenciones de autolesión o situaciones que comprometan su integridad.

La compañía aclaró que muchas personas recurren a ChatGPT no solo para aprender y resolver dudas, sino también para reflexionar sobre temas personales, incluyendo momentos difíciles o cuando buscan contención emocional.

En esos casos, el asistente está diseñado para responder con empatía y alentar al usuario a buscar apoyo profesional. Ahora, además, podrá notificar a ese contacto de confianza si identifica un riesgo grave para la seguridad.

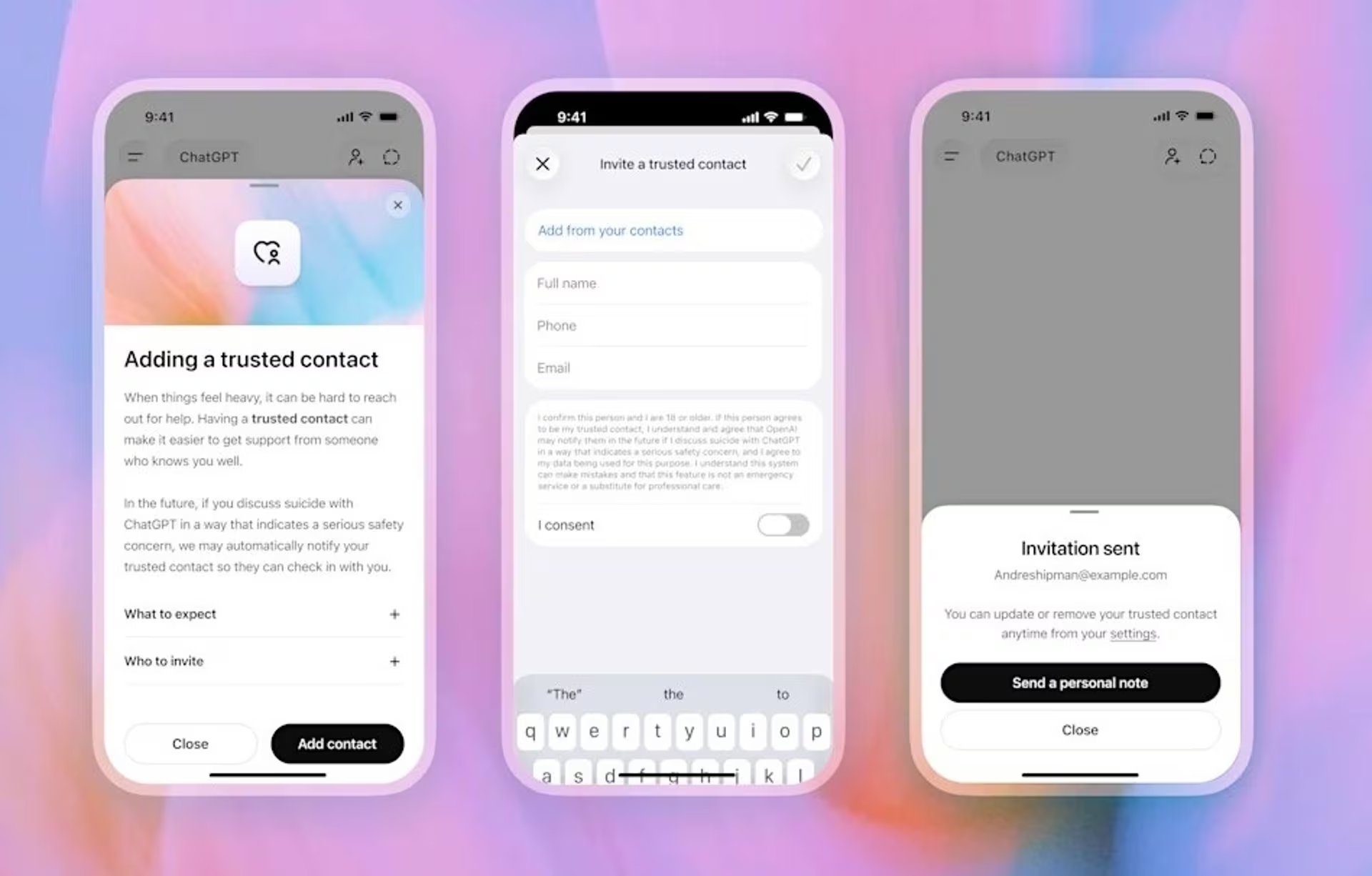

Esta funcionalidad, llamada Contacto de confianza, está disponible para usuarios adultos. Permite seleccionar a una persona —amigo, familiar o cuidador— que será notificada si el sistema detecta comportamientos relacionados con autolesiones que indiquen un riesgo grave para su seguridad.

Según detalló OpenAI en un comunicado oficial, el contacto de confianza busca “ofrecer un nivel adicional de apoyo”, complementando las líneas de ayuda que ya están disponibles en la plataforma.

El mecanismo funciona mediante sistemas de monitoreo automatizado que analizan las conversaciones. Si ChatGPT percibe que el usuario está hablando de hacerse daño o poner en peligro su integridad, un equipo de personas capacitadas de OpenAI revisa el caso. De confirmarse que existe un problema grave de seguridad, se envía una notificación al contacto designado.

La alerta puede llegar por correo electrónico, mensaje de texto o notificación en la aplicación, dependiendo de si la persona de confianza tiene cuenta. El objetivo es que ese contacto intervenga y brinde apoyo, fomentando la conexión con alguien en quien el usuario ya confía.

OpenAI recalcó que esta opción se basa en las notificaciones de seguridad ya existentes para el control parental de menores. Sin embargo, advirtió que no reemplaza la atención profesional ni los servicios de crisis. “ChatGPT seguirá animando a los usuarios a contactar con líneas de ayuda para crisis o servicios de emergencia cuando sea necesario”, aseguró la tecnológica.

Para activar la función, el contacto de confianza debe ser mayor de edad. El usuario puede designarlo desde la configuración de ChatGPT. Luego, la persona elegida recibirá una invitación con una explicación de su rol y deberá aceptarla en un plazo de siete días. Si la rechaza, el usuario podrá seleccionar a otro contacto.

Fuente: Infobae