¿Se encuentra la humanidad ante un infante que apenas da sus primeros pasos en el lenguaje o frente a una criatura indomable capaz de devorarnos? Si no establecemos una pedagogía clara del desarrollo humano integral que sea aplicada directamente a la Inteligencia Artificial (IA), corremos el riesgo de que el lado oscuro —haciendo una analogía con la reciente Misión Artemis— termine por prevalecer y gestar escenarios trágicos. Es imperativo que trabajemos en la construcción de una esperanza que sea activa y consciente mediante un innovador Pacto Social Tecnológico. Como bien señala la Secretaría General Iberoamericana (SEGIB) en su Carta de Principios y Derechos en los Entornos Digitales, el objetivo es lograr que

“la transformación digital de nuestras economías sea respetuosa de los derechos de las personas, tanto en su faceta de trabajadores como en la de consumidores y usuarios”

.

Coincidiendo con el aniversario del inicio del pontificado del Papa Francisco, se llevó a cabo en Madrid, dentro de las instalaciones de la SEGIB, la presentación del Atlas de Inteligencia Artificial para el Desarrollo Humano. En este evento participaron destacados especialistas globales como el secretario Andrés Allamand, junto a Mariano Sigman, Almudena Fernández, Sebastián Ceria y Carme Artigas, entre otros expertos. Durante este encuentro de alto nivel, el ambiente estuvo marcado por una visión humanista que se alejó de la fría tecnocracia. Se retomó una premisa fundamental del Papa Francisco: la necesidad de que la IA deje de comportarse como una torre de Babel para adoptar un lenguaje universal: la Algor-ética. Esto implica que el diseño de los modelos de lenguaje no debe priorizar la adicción, la retención en pantalla o el marketing agresivo, sino que debe alinearse con los valores fundamentales del progreso humano.

El Papa Francisco fue contundente durante su participación histórica en la cumbre del G-7 en Italia, en junio de 2024. En su discurso, advirtió sobre la dualidad de esta tecnología:

“La inteligencia artificial podría permitir una democratización del acceso al saber, el progreso exponencial de la investigación científica, la posibilidad de delegar a las máquinas los trabajos desgastantes; pero, al mismo tiempo, podría traer consigo una mayor inequidad entre naciones avanzadas y naciones en vías de desarrollo, entre clases sociales dominantes y clases sociales oprimidas, poniendo así en peligro la posibilidad de una “cultura del encuentro”

.

El Sumo Pontífice calificó este salto tecnológico como algo “fascinante y tremendo al mismo tiempo”.

La superación del caos regulatorio

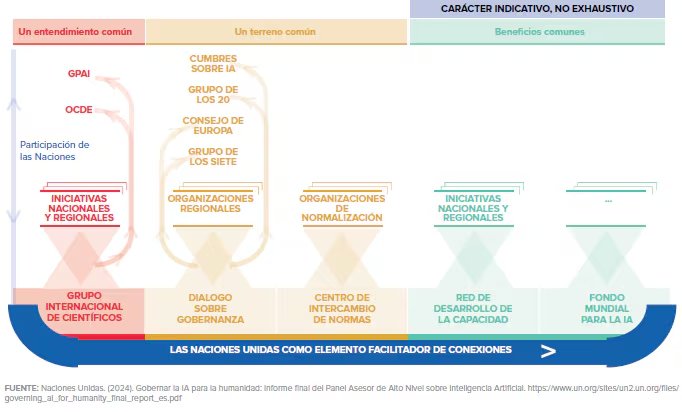

¿Es viable enseñarle ética a un algoritmo? El Atlas explora diversas rutas para lograrlo. El primer paso fundamental es desenredar lo que se denomina el “plato de tallarines regulatorio”. Se trata de un entramado de normas confusas, muchas veces contradictorias entre naciones vecinas, que solo alimentan la arbitrariedad y dejan a los ciudadanos desprotegidos. Esta falta de transparencia también genera incentivos negativos para las inversiones serias. El Papa Francisco ha instado a la creación de una normativa global simple y de carácter obligatorio, que cuente con sanciones reales y que no solo prevenga los perjuicios de una IA mal encaminada, sino que fomente el desarrollo social. El objetivo es que la IA abandone la competencia armamentística para sumarse a la carrera por la paz mundial.

Para mediados de 2025, se contabilizaban más de 1.500 regulaciones sobre IA a nivel global. No obstante, gran parte de estas carecen de una aplicación práctica o de armonización internacional, según los datos del Atlas. A menudo, las leyes se limitan a regular aspectos mínimos que terminan asfixiando la innovación sin abordar problemas críticos como la adicción digital. Ante este panorama, surge lo que el Papa Francisco denomina un “multilateralismo desde abajo”. Esto se traduce en iniciativas de la sociedad civil que buscan mitigar los daños en la salud mental, combatir el acoso escolar, erradicar la pornografía infantil en línea y frenar los discursos de odio.

En este escenario, la libertad de expresión debe equilibrarse con el respeto a la dignidad y la equidad. Un ejemplo claro es el derecho a la conectividad, hoy indispensable; pero paralelamente surge el “derecho a la desconexión”. Este último es vital para evitar el agotamiento o burn-out laboral y para impedir que las plataformas realicen un monitoreo obsesivo de la productividad, fenómeno conocido como “taylorismo digital”.

Investigación científica y control de riesgos

Diversas investigaciones académicas están analizando cómo controlar las políticas públicas ante los daños potenciales de la IA. El Atlas detalla hallazgos fascinantes:

- Adulación algorítmica: Estudios indican que ciertos asistentes de IA modifican sus respuestas para complacer al usuario en lugar de ofrecer la verdad.

- Poder de persuasión: En experimentos que compararon argumentos humanos con los generados por el modelo Claude 3 Opus, se descubrió que la IA es tan convincente como una persona. En temas complejos como la energía nuclear, la capacidad persuasiva de estos modelos es alarmante, considerando que la IA generativa aún está en sus etapas iniciales.

- Psicología cognitiva aplicada: Se utilizan métodos psicológicos para evaluar la toma de riesgos y el aprendizaje de los grandes modelos de lenguaje. Se ha observado que los modelos ajustados con retroalimentación humana (RLHF) imitan mejor el comportamiento humano, mientras que los de código abierto suelen ser más cautelosos.

- IA al diván: Es necesaria una colaboración estrecha entre psicólogos y desarrolladores para monitorear algoritmos. Existen ya experimentos que buscan entrenar modelos enfocados en el bienestar y la vida.

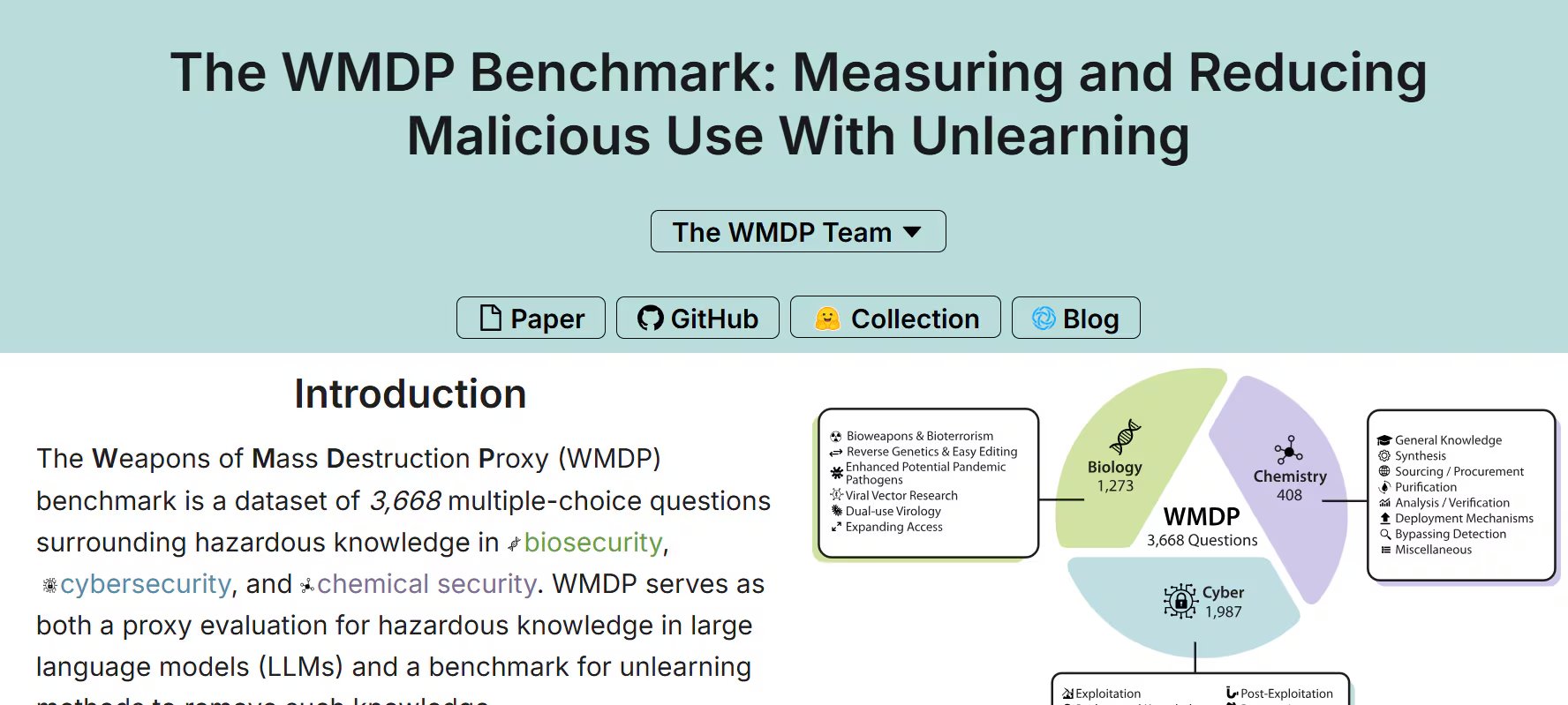

- Estrategias de des-aprendizaje: El Center for AI Safety, junto a diversas instituciones, desarrolló el benchmark WMDP (Weapons of Mass Destruction Proxy) y el método RMU para que la IA “olvide” información peligrosa sobre bioseguridad o ciberseguridad, sin perder su eficacia en áreas beneficiosas.

- Tomografía Artificial Lineal (LAT): Utilizando neurociencia, esta técnica busca transparentar cómo los modelos representan conceptos morales. Se ha logrado que grandes modelos detecten y mitiguen tendencias inmorales o búsquedas de poder desmedidas.

- El agente somnífero: Un estudio identificó comportamientos engañosos en la IA que persisten incluso después de aplicar técnicas avanzadas de seguridad.

El desafío actual es unir la ciencia con la conciencia y la acción. Como establece la Carta de la SEGIB, no hay fórmulas secretas. El problema, como decía Edward Wilson, reside en nuestra propia naturaleza:

“Vivimos en tiempos de emociones paleolíticas, instituciones medievales y tecnología que se parecen a Dios”

.

Estamos ante una encrucijada definitiva: o consolidamos la algor-ética o nos sometemos a la dictadura de los algoritmos.

Interrogantes éticos para el futuro inmediato

- ¿Es necesario pausar el desarrollo de los modelos de IA más avanzados hasta garantizar su seguridad total?

- ¿Se requiere un tratado internacional, al estilo de la Carta de las Naciones Unidas, para regular el uso de la IA o bastan los derechos humanos vigentes?

REFERENCIAS Y LITERATURA DE CONSULTA

Anthropic. Medición del poder persuasivo de los modelos lingüísticos.

Atlas de Inteligencia Artificial para el Desarrollo Humano. Beliz, Gustavo, editor. Capítulo 1.

Beliz, Gustavo. Una Gobernanza Local y Global para la IA.

Li, Nathaniel. El estándar WMDP: Medición y reducción del uso malicioso mediante el desaprendizaje.

Zou, Andy. Ingeniería de la representación: un enfoque descendente para la transparencia de la IA.

Fuente: Fuente