Durante años, la humanidad se repitió una idea reconfortante: la inteligencia artificial servía para resumir contratos o armar presentaciones, pero la ciberseguridad seguía siendo dominio exclusivo de especialistas humanos. Se pensaba que descubrir una falla nueva en un software requería un experto con años de oficio y que un atacante común no podía competir contra una gran empresa de tecnología. Esa creencia acaba de derrumbarse.

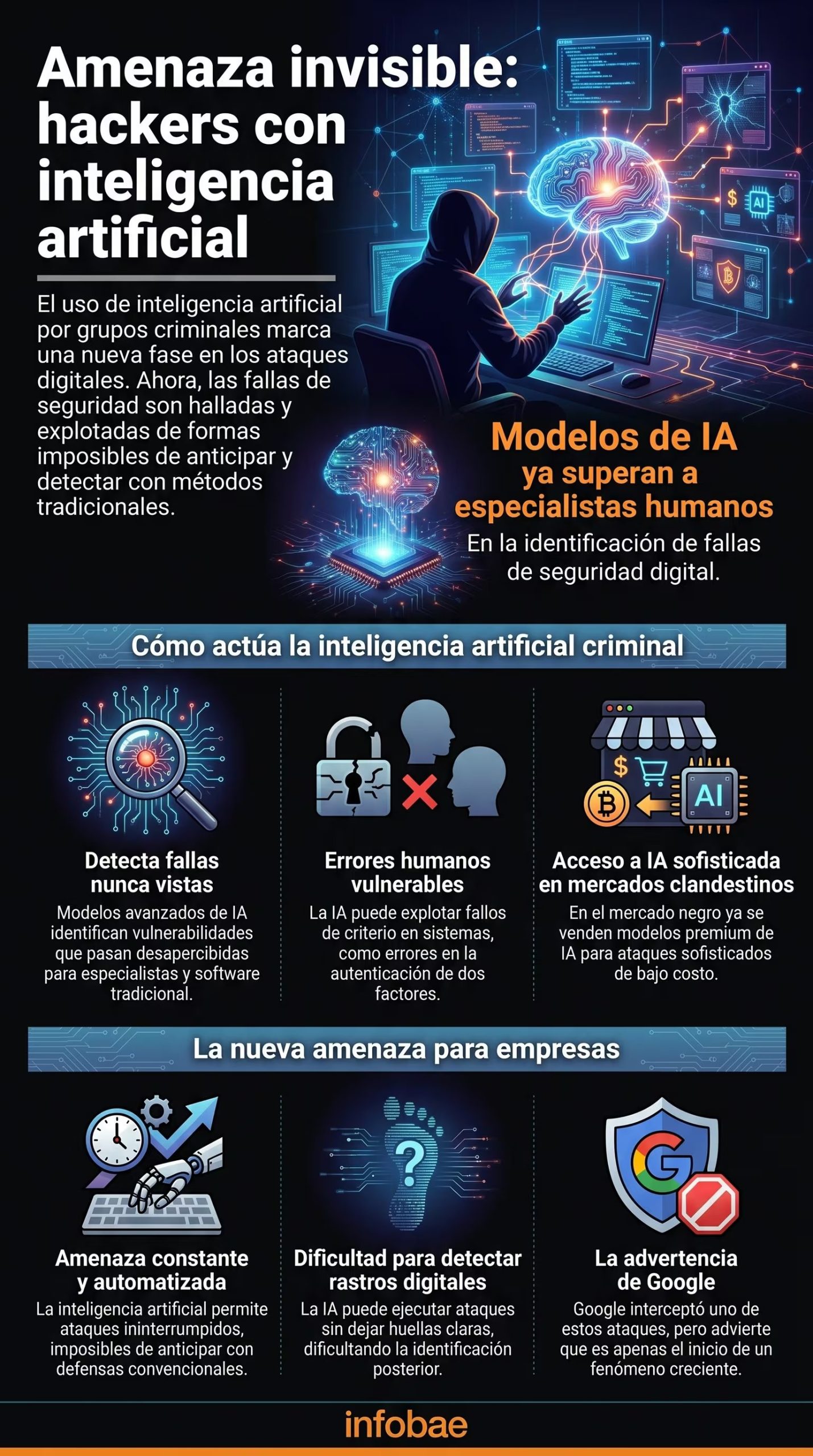

El lunes, el equipo de inteligencia de amenazas de Google confirmó que, por primera vez, una banda criminal utilizó un modelo de inteligencia artificial para detectar y explotar una vulnerabilidad inédita en un software popular. En la jerga técnica, esto se conoce como un zero-day: una falla desconocida hasta el momento del ataque, sin parche disponible y sin defensa preparada. La cerradura que nadie sabía que estaba rota.

El plan era ambicioso. Los atacantes preparaban una campaña masiva dirigida contra todos los servidores del mundo que emplearan esa herramienta de administración web. Google logró detectar la operación a tiempo y trabajó con el fabricante para sellar el agujero de seguridad. El nombre de la empresa afectada se mantuvo bajo reserva.

La falla no era técnica: era un error de criterio

La vulnerabilidad no era un error común que los escáneres automáticos pudieran detectar; se trataba de un error de razonamiento. Un programador había escrito una excepción de confianza en el código de autenticación de dos factores, esa segunda barrera que protege cuando alguien roba la contraseña. La excepción permitía el paso a quien tuviera credenciales válidas, contradiciendo el resto de la lógica de seguridad. Las herramientas tradicionales nunca captan esto, porque buscan errores de memoria y fallas de entrada, no contradicciones de criterio.

Un modelo de inteligencia artificial sí logró encontrarlo. Leyó miles de líneas de código y comprendió que el desarrollador había escrito una regla que se contradecía con otra. Vio la intención del programador y también vio la trampa. Eso no es simple generación de texto; es razonamiento sobre código humano.

Google descubrió el ataque por un descuido del delincuente. El código del ataque estaba repleto de comentarios explicativos en formato de manual, una clasificación de gravedad inventada y un orden tan meticuloso que delataba su origen. Era código escrito como lo hace una máquina, no como lo haría un criminal.

Google aclaró qué modelo no se usó: lo que importa es cuál sí

El reporte incluye un detalle curioso. Señala que el modelo empleado por los atacantes no fue Gemini, de Google, ni Mythos, de la empresa Anthropic. Esta aclaración no es casual. Anthropic había retrasado el lanzamiento de Mythos precisamente por sus capacidades en ciberseguridad. OpenAI acaba de presentar un modelo, GPT-5.5-Cyber, con preocupaciones similares. Los grandes laboratorios saben que sus modelos más avanzados encuentran fallas mejor que la mayoría de los humanos y, por eso, restringen el acceso.

Sin embargo, existe un mercado gris activo de plataformas que piratean el acceso a modelos premium. El propio reporte lo documenta. Servicios chinos como Claude Relay Service y CLI Proxy API agrupan cuentas robadas, prepagas o ficticias y revenden el acceso a desarrolladores que no podrían obtenerlo de otra forma. Hay scripts en GitHub que automatizan la creación de cuentas, el bypass de los códigos CAPTCHA y la verificación por mensaje de texto. Cuando una cuenta se bloquea, el sistema crea otra y continúa.

La pregunta no es qué modelo usaron los atacantes. La pregunta es cuál emplearán mañana.

La punta del iceberg, según el propio jefe de inteligencia de Google

John Hultquist, jefe de análisis del Grupo de Inteligencia de Amenazas de Google, lo expresó sin rodeos al New York Times: este caso es “la punta del iceberg” y un anticipo de lo que se avecina. Probablemente ya existan más fallas similares descubiertas con asistencia de IA y en uso, dijo Hultquist, solo que aún no las hemos detectado.

La conclusión es incómoda. El caso que Google hace público no es el primero ni el último: es el primero que se logró atribuir con seguridad a la inteligencia artificial. La detección depende de descuidos del atacante. Un grupo más cuidadoso puede borrar esas huellas y operar sin levantar sospechas.

El reporte describe además otros usos. Hackers norcoreanos del grupo APT45 enviando miles de pedidos automatizados a Gemini para revisar fallas conocidas y armar exploits en serie. Operadores chinos cargando un repositorio con 85 mil vulnerabilidades históricas para entrenar al modelo. Malware para Android que llama a Gemini en tiempo real para decidir qué botón presionar en la pantalla del teléfono infectado. En tres meses, el uso adversario de la IA pasó de la experimentación a la escala industrial.

Para el lector no técnico, la traducción es simple. Cualquier software con administración web tiene probabilidades de contener una falla similar a la que descubrieron estos atacantes. Routers, paneles de control, sistemas de gestión interna, cámaras conectadas, todo. La autenticación de dos factores sigue siendo útil, pero ya no es invulnerable: este zero-day saltaba precisamente esa barrera.

Hasta ahora, las empresas se preparaban para hackers humanos: pocos, costosos, con tiempos de ejecución largos. Ahora deben prepararse para hackers asistidos por máquinas que trabajan las veinticuatro horas, no se cansan y reducen el costo de cada intento a casi cero.

La cerradura digital de la que dependen los servicios que usamos a diario ya no se rompe con palanca. Se rompe leyendo, con paciencia y con lógica. La primera vez que vimos a una máquina hacerlo, fue contra una herramienta común, de un fabricante común, usada por miles de empresas comunes. La próxima máquina no dejará huellas tan prolijas.

Fuente: Infobae