Cuando OpenAI anunció la semana pasada el lanzamiento de GPT-5.4-Cyber, un modelo de inteligencia artificial con acceso restringido a un grupo selecto debido a riesgos de ciberseguridad, no presentó ninguna novedad real. Tan solo siete días antes, Anthropic había presentado Claude Mythos Preview bajo la misma premisa: acceso limitado, idéntico argumento y una puesta en escena prácticamente calcada.

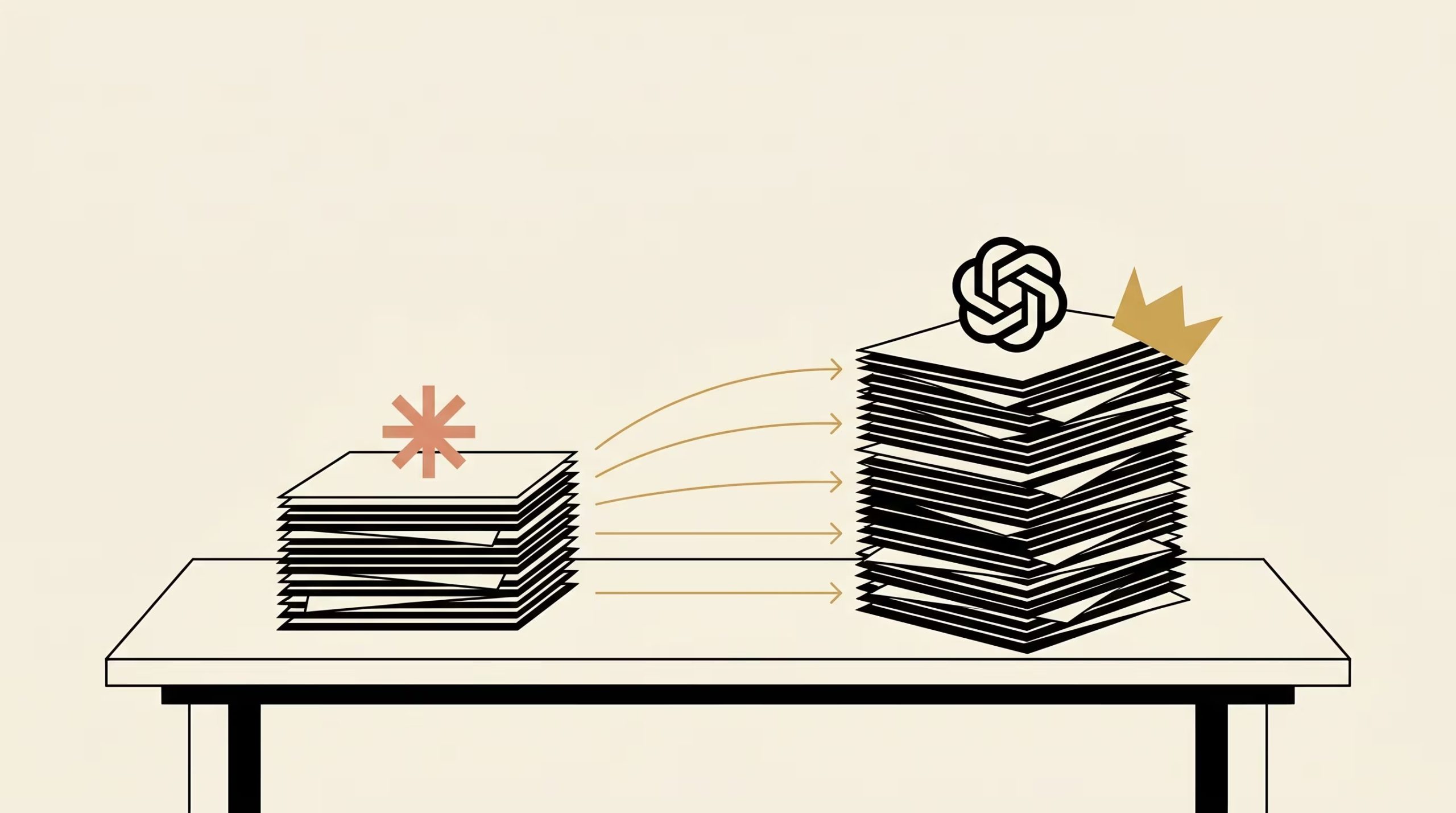

Este comportamiento se repite desde hace meses. Cuando Anthropic lanzó Claude Code en 2025, OpenAI respondió con Codex. Luego Anthropic presentó Claude Cowork, una herramienta que permite controlar el escritorio del usuario, y OpenAI actualizó Codex en abril para incluir esa misma funcionalidad. Más recientemente, Anthropic publicó la versión más reciente de su Constitution, el documento que define las reglas de comportamiento del modelo, y OpenAI montó una campaña para promocionar su propio documento equivalente.

La dinámica de inversión jerárquica quedó documentada en The Atlantic. Matteo Wong escribió el 28 de abril que OpenAI corre para alcanzar a su mayor rival. Anthropic anunció a comienzos de abril una facturación anualizada de USD 30.000 millones, cifra que aparentemente ya superó a la de OpenAI, y su valoración en algunos mercados privados secundarios ya supera el USD 1 billón.

El pivot interno confirma la inversión

Los memos internos de OpenAI, filtrados por The Atlantic, revelan a una empresa en modo defensivo. Denise Dresser, contratada en diciembre como chief revenue officer de OpenAI tras haber sido CEO de Slack, escribió sobre su rival: “su historia está construida sobre el miedo”. Otro memo de marzo advertía que el éxito de Anthropic en los sectores de código y empresa debía ser considerado una “señal de alarma” para OpenAI.

La respuesta operativa fue contundente. OpenAI decidió dar de baja Sora, su proyecto de video generativo. Lanzó las Frontier Alliances con McKinsey y Boston Consulting Group para acelerar la adopción de ChatGPT en grandes corporaciones. También presentó un nuevo plan ChatGPT Pro de USD 100 mensuales, que ofrece cinco veces más uso de Codex, como respuesta directa al Max 5x de Anthropic, según reportó CNBC. Además, publicó un plugin oficial de Codex que funciona dentro de Claude Code: una estrategia para distribuir su producto dentro de la interfaz del competidor y no perder a los desarrolladores que ya eligieron al rival.

TechCrunch lo resumió en una frase el 16 de abril: hay una guerra de baja intensidad entre OpenAI y Anthropic por las herramientas de programación, y por ahora Anthropic la está ganando.

El único terreno donde OpenAI no puede copiar

La copia funciona en el ámbito de los productos. Pero no funciona en el posicionamiento ético. Cuando Anthropic se negó a otorgarle al Pentágono acceso sin restricciones a Claude, argumentando que sus términos de uso prohíben la vigilancia masiva doméstica y las armas autónomas, el Departamento de Defensa la calificó como “riesgo de cadena de suministro”, una categoría que normalmente se reserva para adversarios extranjeros. Actualmente hay un juicio en curso. Mientras tanto, OpenAI y xAI firmaron contratos con el Pentágono semanas antes. Google firmó el suyo el 28 de abril, según The Wall Street Journal y TechCrunch, a pesar de una carta abierta firmada por 950 de sus empleados que le pedían seguir el camino de Anthropic.

La copia funciona en producto. No funciona en posicionamiento ético. Anthropic estableció límites de uso en sus contratos con el Departamento de Defensa de Estados Unidos y mantiene un litigio abierto con la entidad. OpenAI y xAI firmaron contratos sin esas restricciones semanas antes. Google firmó el suyo el 28 de abril, según The Wall Street Journal y TechCrunch.

El “miedo” que Dresser ridiculiza en su memo interno es el mismo activo que le ha permitido a Anthropic ganar terreno en el sector empresarial. Mientras OpenAI corre detrás del producto, su rival cobra por una posición que no puede ser copiada.

OpenAI puede copiar Claude Code con Codex, y puede copiar Cowork con control de escritorio. Pero no puede copiar los límites que Anthropic se autoimpuso, porque ya firmó sin ellos. Cuando el competidor construye su marca como “el que dice que no”, copiar productos no es suficiente. También hay que poder decir que no, y para eso ya no queda margen.

Fuente: Infobae