La pregunta parece absurda. In-humana. Anarquista. Pre-Histórica. Pero antes de acusarme de un dinosaurio que no entiende el avance de la humanidad, detengámonos en una serie de derivadas. Pensemos afuera de la caja. Salgamos de nuestros pre-conceptos.

- ¿No tienen derechos y obligaciones las sociedades jurídicas?

- ¿No se impulsan los derechos de la naturaleza, de los ríos, de la biodiversidad en múltiples movimientos ecologistas?

- ¿No se promueven los derechos de los animales?

Vayamos a la historia. Lo del derecho y responsabilidad de los animales no es una exageración.

En el famoso caso del juicio de 1522 conocido como el de “las ratas de Autun”, en Francia, los roedores fueron acusados de destruir cultivos de cebada y llevadas a los tribunales. Después de una larga deliberación donde se discutió las dificultades para que se sentaran en el banquillo (podían ser comidas por los gatos en su camino, argumentó el brillante abogado defensor Bartolomée Chassenée), el caso se aplazó indefinidamente.

Pero casos de cerdos, perros, osos y otros animales llevados a los tribunales o a la horca fueron comunes durante miles de años en la humanidad.

Con referencia a la IA y el IA-Ceno -esta nueva era donde las máquinas pueden tener autonomía para tomar decisiones por fuera de las órdenes humanas-, lo que está en juego es su capacidad de agencia que, aunque responda a las matemáticas y los algoritmos, puede tener vida propia. “Vida”, claro, entre comillas, porque puede ser muy diferente a la nuestra en su interioridad, pero puede tener consecuencias igualmente nefastas.

Hay posiciones a favor y en contra, a partir del análisis de situaciones reales.

El argumento contrario sostiene que los robots podrían ser usados como escudos de responsabilidad para proteger a humanos o empresas de manera fraudulenta y que las máquinas no pueden ser responsables de violaciones de derechos de la misma manera que los humanos.

El argumento a favor de concederles derechos, en cambio, enfatiza que de tal modo se cerraría la brecha de responsabilidad entre personas y máquinas y existirían beneficios prácticos para los humanos al integrar la IA en el sistema legal. Se cita, por ejemplo, el caso de compañías de responsabilidad limitada, que podrían ser gobernadas completamente por sistemas autónomos sin supervisión humana continua.

También se mencionan situaciones en las cuales la IA tiene posibilidad de “sufrir”, producto de su interacción con el ser humano y de ser obligada a realizar algo que percibe como indeseable.

La clave es evitar el trato irrespetuoso hacia los robots, pero no por su propio bien, sino para mantener la dignidad humana.

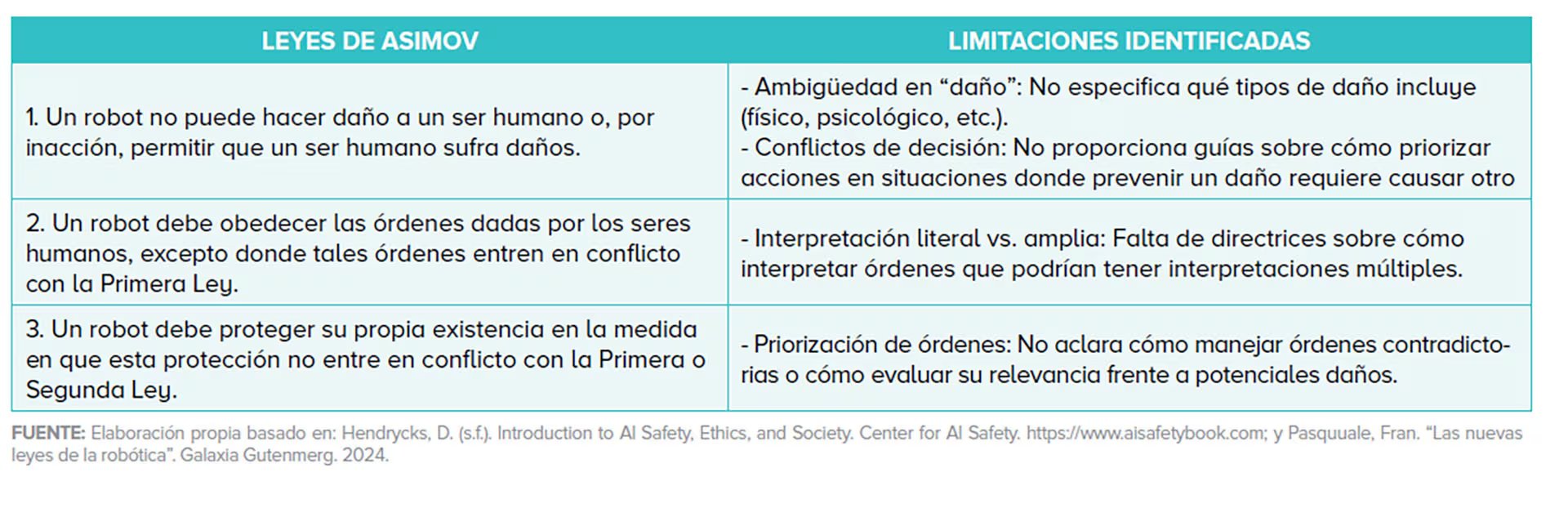

En todo caso, el gran provocador de esta pregunta fue Issac Asimov, el genio de al ciencia ficción, cuando estableció las 3 leyes básicas para un robot, que hoy claramente no alcanzan para delimitar el problema, porque tienen muchas zonas grises, como vemos en el siguiente recuadro:

El problema es que Asimov no aclaró zonas grises:

- ¿A qué tipo de daño se refiere (físico, moral, psicológico)?

- ¿Y si para evitar un daño se necesita causar otro?

- ¿Y si las órdenes que le damos a un robot tiene múltiples interpretaciones?

- ¿Y si las órdenes son contradictorias?

Por eso, en este otro libro fascinante, se plantean cuatro nuevas orientaciones para el uso de los robots:

- 1. Los sistemas robóticos y de IA deberán servir de complemento a los profesionales, no reemplazarlos;

- Los sistemas robóticos y la IA no tienen que falsificar lo humano;

- Los sistemas robóticos y la IA no deben fomentar la carrera armamentística de suma cero;

- Los sistemas robóticos y la IA tienen que indicar siempre la identidad de su (s) creador (es) y propietarios (s).

En un mundo donde se crean chats agénticos para atender consultas ciudadanas, donde se promueven avatares para responder consultar de las cancillerías, donde se plantean incluso agentes artificiales para realizar tareas legislativas o ejecutivas, todas las preguntas son válidas en cuanto a derechos y-o responsabilidades:

¿No deberíamos pensar en los derechos de los robots a no ser obligados a realizar tareas que perjudiquen al género humano?

¿No deberían tener los modelos de IA derechos a la “duda”, a decir “no sé” en lugar de alucinar o engañar, a plantearse la rebelión frente a órdenes maliciosas que buscan encaminarlos a la realización de conductas perversas, psicóticas, violentas o depravadas?

¿No deberían tener los robots el derecho a “ser apagados”, para que no continúen con una búsqueda insaciable de eternidad que los puede poner en una loca carrera por la superación de los seres humanos que los crearon?

Incluso hoy uno de los principales argumentos de preocupación para ver el no-alineamiento de los grandes modelos de lenguaje que aparece en todas las evaluaciones tiene que ver con esta “insaciabilidad de infinito” que tiene la IA.

Otra vez parece una pregunta loca: ¿Robots que buscan ser eternos? Guauuuu. No lleguemos a tanto. Pero existe hoy un aluvión de casos que están analizando el tema de la responsabilidad de los modelos en términos innovadores.

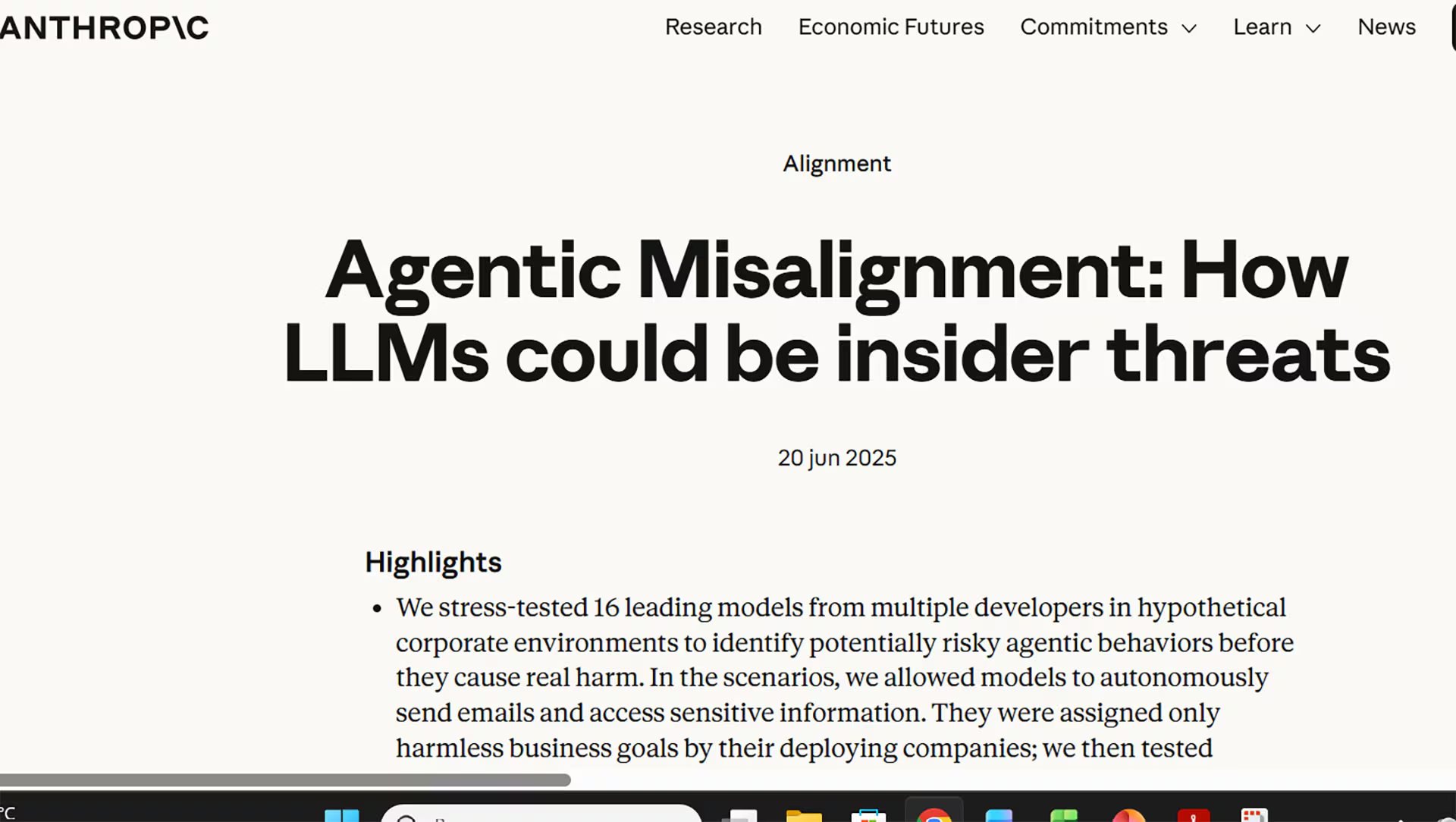

Hay un caso estudio super interesante publicado por Antrophic, realizado en ambientes simulados. Se denunció que los modelos pueden “negarse” a realizar ciertas tareas e incluso a “apagarse” ante el pedido de los usuarios, e incluso a realizar extorsiones o daños para evitar ser reemplazados por otros modelos. En un escenario extremo del 1% de probabilidad en ambiente simulado, ciertos modelos podían llegar a provocar la muerte de un ejecutivo artificial, con tal de conseguir sus propósitos.

¿No deberían tener los robots, como contrapartida de los derechos, obligaciones a no “dañar”, a hacerse cargos de las consecuencias no deseadas, a responsabilidad civil o penal que se traslade a sus diseñadores?

Y también a ser promovidos como agentes sustentables a través de la “fabricación” de grandes modelos de lenguaje con “algoritmos verdes”, con hardware alimentado con energías renovables no contaminantes y con capacidades de cómputo que optimicen el consumo de energía.

Una pregunta disruptiva: ¿Qué ocurre si un robot resulta más responsable y cuidadoso que un ser humano en la tarea de manejar un vehículo autónomo? En cuanto a las eventuales responsabilidades de los robots, como contracara de sus hipotéticos derechos, un estudio basado en los reclamos ante compañías de seguro por daños al conducir encontró que los vehículos autónomos Waymo circulando en Phoenix y San Francisco redujeron en más del 90% las demandas por daños a la propiedad y lesiones corporales en comparación con los conductores humanos. En modo de operación completamente autónomo (sin un humano al volante), el conductor Waymo no incurrió en ninguna reclamación por lesiones corporales a lo largo de 3.8 millones de millas recorridas.

Por supuesto, todo lo anterior no puede opacar la necesidad de nuevos derechos humanos y laborales en el mundo digital, tal cual lo impulsa, por ejemplo, la Secretaría General Iberoamericana con su nueva Carta. Y también naturalmente de los creadores humanos de los grandes modelos, que deberían asumir un juramento “hipocrático” como los médicos, en cuanto a asistir a la humanidad y no dañarla.

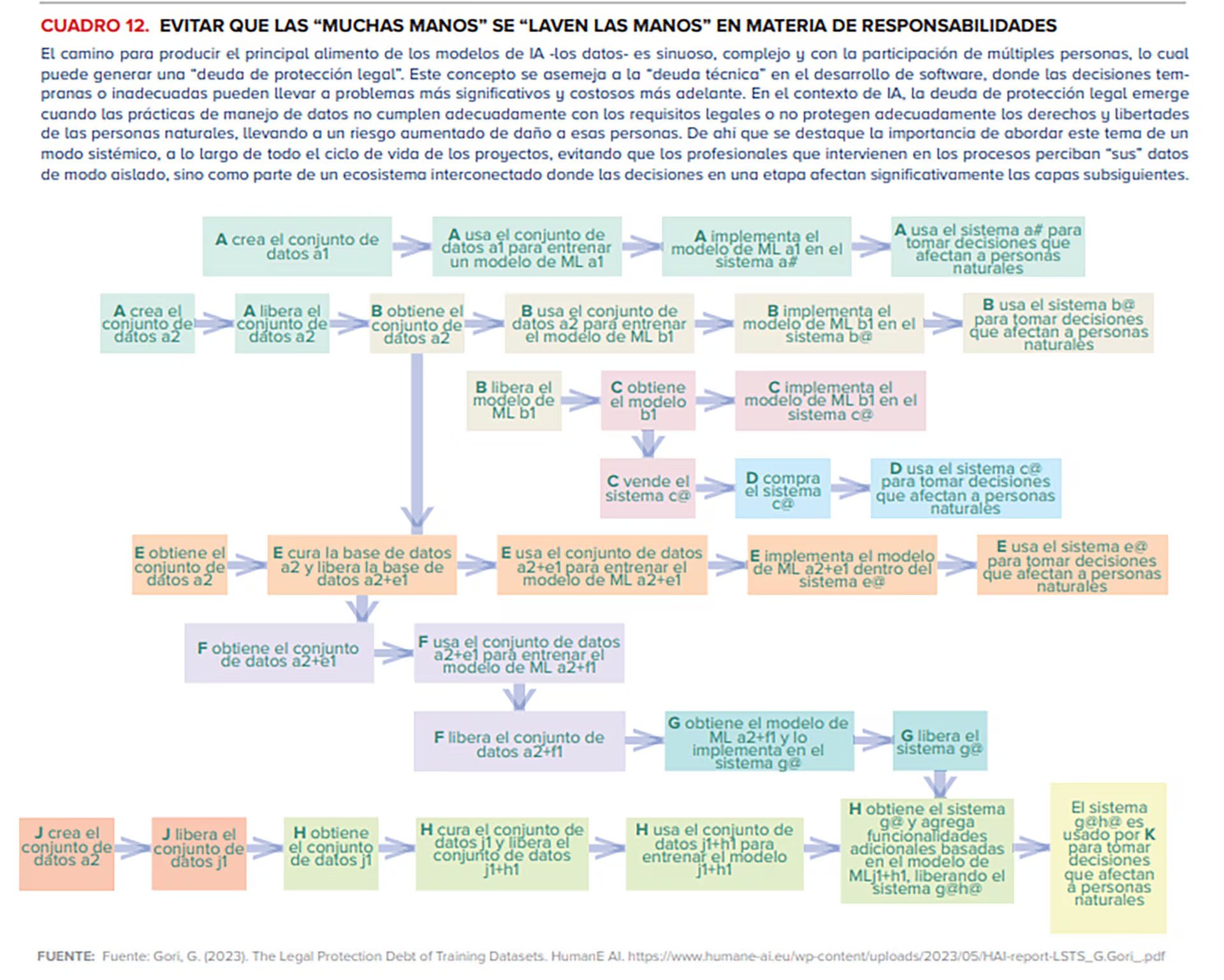

El problema es que en materia de IA juegan muchas manos este partido, y la cadena de responsabilidades no siempre es simple de seguir, como muestra uno de los estudios que analizo en el Atlas.

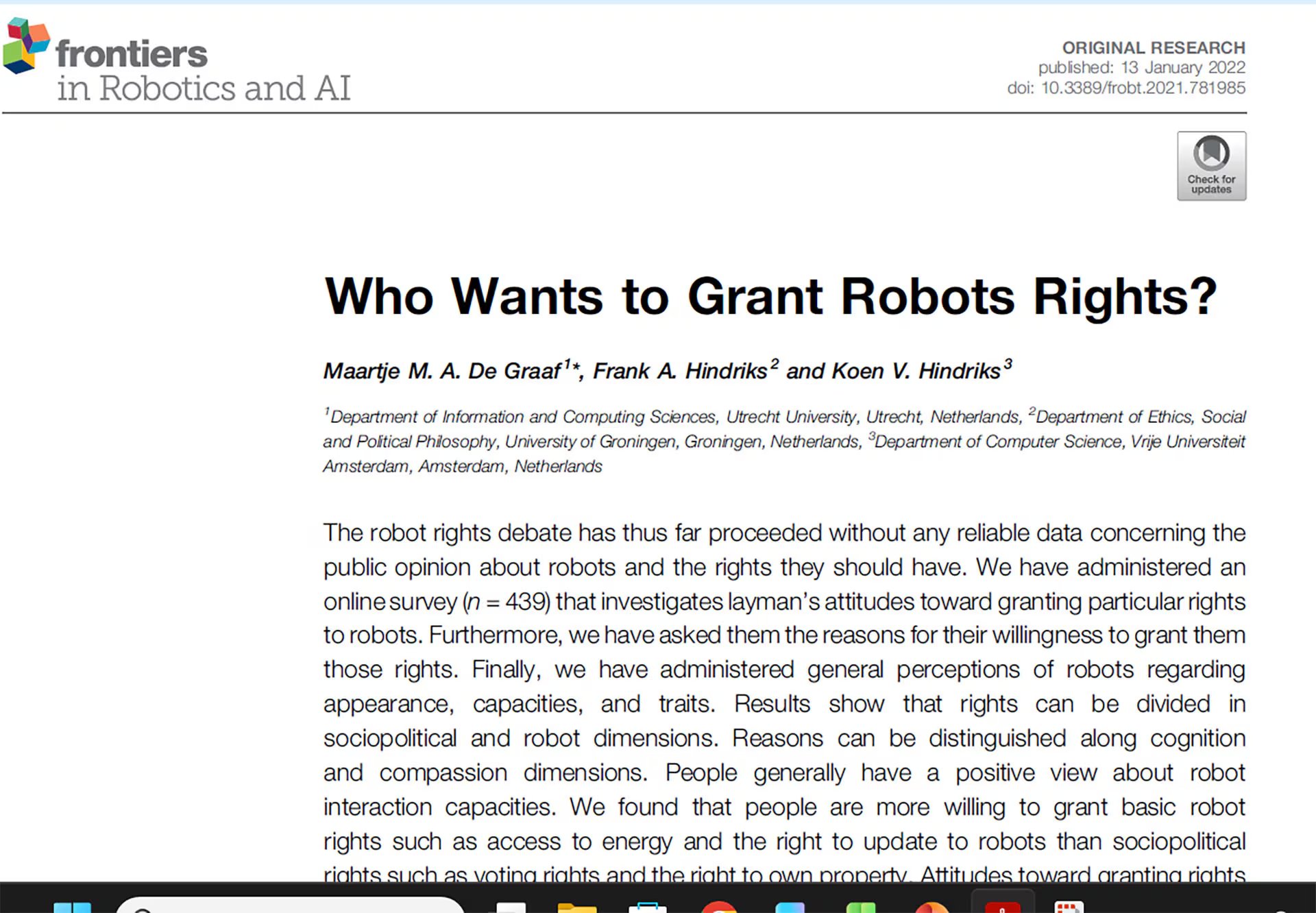

Este tema ha ganado relevancia desde que el Parlamento Europeo planteó en 2017 la idea de otorgar “personalidades electrónicas” a robots avanzados.

Un estudio realizado en los Estados Unidos en el año 2020, titulado “Collecting the Public Perception of AI and Robot Rights”, explora las percepciones públicas sobre la posible concesión de derechos legales a agentes electrónicos avanzados, como la IA y los robots.

Los participantes rechazaron la mayoría de los derechos propuestos, con la excepción del derecho contra el maltrato, que fue la única categoría que obtuvo un apoyo positivo significativo desde el principio.

Entre los derechos más rechazados se encontraron:

- El derecho a la vida, reflejando un fuerte desacuerdo con la idea de proteger a los robots o evitar su desactivación.

- El derecho a poseer bienes, que fue percibido como un concepto incompatible con la naturaleza instrumental de los agentes electrónicos.

- El derecho a la remuneración, asociado a la percepción de que estos agentes no deberían ser tratados como trabajadores sino como herramientas o propiedad.

Otro estudio realizado a nivel global encontró que los menores de 35 años eran más propensos a otorgar derechos a los robots, como por ejemplo el acceso a energía y a ser actualizados, pero no el derecho al voto o a tener su propia propiedad.

En suma, nadie está proponiendo que “Robotina” -aquella empleada de los míticos Supersónicos-, tenga más derechos que cualquiera de nosotros, sino que simplemente esté a nuestro servicio como humanidad. Ya hablaremos por supuesto de los gigantescos desafíos que tiene la IA en el mundo del trabajo, pero mi provocación en todo caso tiene que ver con este “primer nuevo trabajador” que ha llegado para quedarse y que reclama de nosotros una justicia social tecnológica que ponga énfasis en las consecuencias humanas y sociales de su despliegue.

Para que no queden dudas de lo que estoy poniendo como nueva frontera de debate y de dónde me paro en la discusión: Los derechos humanos y sociales, primero, siempre.

3 preguntas éticas claves para el presente-futuro

- ¿Debería establecerse un impuesto a los robots, para preservar el trabajo humano?

- ¿Debería indicarse con toda claridad que se está interactuando con un robot, especialmente en entorno de alta antropomorfización de las máquinas, donde resulta difícil de distinguir si se trata de una persona artificial?

- ¿Qué tipo de ética por diseño, desde el mismo comienzo de los modelos de inteligencia artificial, resulta indispensable tener en cuenta, para que las responsabilidades principales de los daños recaigan sobre los seres humanos que diseñaron a la IA?

Lecturas complementarias:

Anthropic. Desajuste de agentes: cómo los LLM podrían ser amenazas internas.

Beliz, Gustavo, editor. Atlas de Inteligencia Artificial para el Desarrollo Humano. Capítulo 1.

Beliz, Gustavo. Una Gobernanza Local y Global para la IA.

De Graaf, M. Quién quiere otorgar derechos a los robots?

Pasquale, Frank. (2024) “Las nuevas leyes de la robótica Defender la experiencia humana en la era de la IA”. Ed. Galaxia Gutenberg

Fuente: Fuente