Los invito a realizar un ejercicio de imaginación basado en la icónica producción de los años 70, “El túnel del tiempo”. En dicha trama, sus protagonistas lograban viajar a distintos periodos del pasado, actuando como testigos y partícipes de los eventos más determinantes de nuestra historia.

En la actualidad, cruzar ese umbral implica experimentar tres etapas históricas que convergen de manera simultánea y que poseen una trascendencia vital para la sociedad contemporánea.

La convergencia de tres hitos históricos

- En primer lugar, nos encontramos en un “momento Ford o Taylor”. Se trata de la consolidación de sistemas de producción masiva que, en su origen, permitieron el acceso a bienes como automóviles y electrodomésticos gracias a la electricidad y el vapor. No obstante, hoy esta tendencia evoluciona hacia un Taylorismo digital. Esto implica el uso de algoritmos para la vigilancia exhaustiva de la productividad laboral, pero también abre la puerta a una eficiencia sin precedentes. Un ejemplo positivo es el uso de robots inteligentes en sectores peligrosos como la minería, evitando que seres humanos tengan que descender a las profundidades de la tierra.

- Simultáneamente, atravesamos un “momento Apolo-Sputnik”. Al igual que la competencia espacial entre las potencias tras la Segunda Guerra Mundial derivó en la creación de internet para uso civil, hoy presenciamos una nueva carrera. Esta incluye desde la planificación de data centers espaciales para optimizar el consumo energético hasta el despliegue de satélites que garantizan la conectividad para usuarios rurales y productores agrícolas mediante el internet de las cosas.

- Finalmente, la Inteligencia Artificial (IA) nos sitúa en un “Momento Manhattan”. Esta analogía nos remite a la impactante escena de la película Oppenheimer, donde la incertidumbre sobre una posible catástrofe global precedía a la primera prueba nuclear. Aquellos descubrimientos atómicos tuvieron fines bélicos devastadores, pero también generaron una conciencia global sobre la imposibilidad de usar el “botón rojo” debido al riesgo de aniquilación mutua.

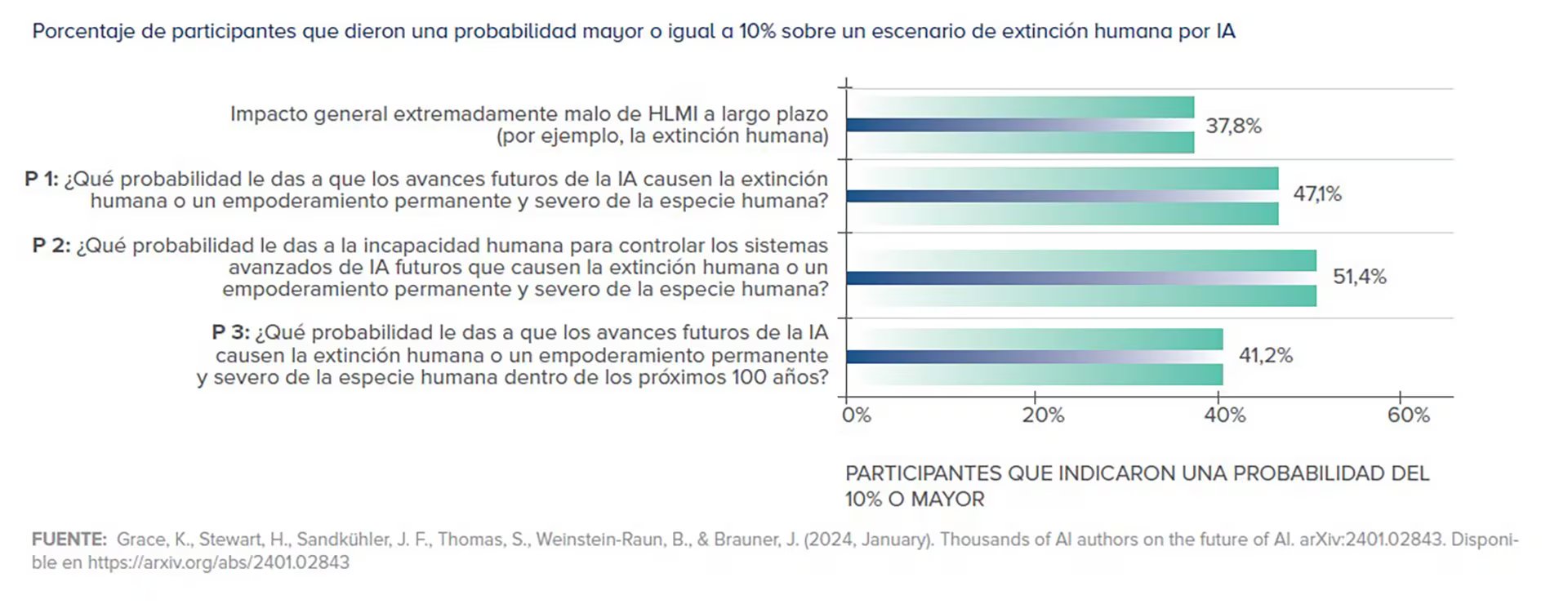

Históricamente, la legalidad internacional terminó prevaleciendo. Aunque la firma del Tratado de No Proliferación Nuclear demoró 23 años y enfrentó múltiples obstáculos, se consolidó como una herramienta de protección ante riesgos existenciales. Actualmente, la IA demanda el establecimiento de “líneas rojas” que impidan que el desarrollo de una Super-IA escape al control humano, lo que derivaría en consecuencias de escala catastrófica.

¿Estamos ante una tecnología equivalente a la bomba nuclear?

En el marco del Atlas de IA para el Desarrollo Humano, se han analizado las analogías entre estos fenómenos tecnológicos.

Existen factores de riesgo alarmantes: fabricar una “bomba atómica de IA” es hoy mucho más sencillo y discreto. A diferencia del armamento nuclear, no se requiere uranio, plutonio ni instalaciones físicas de gran envergadura. Modelos de código abierto, lanzados en ocasiones sin protocolos de seguridad suficientes, podrían ser utilizados para el diseño de armas biológicas.

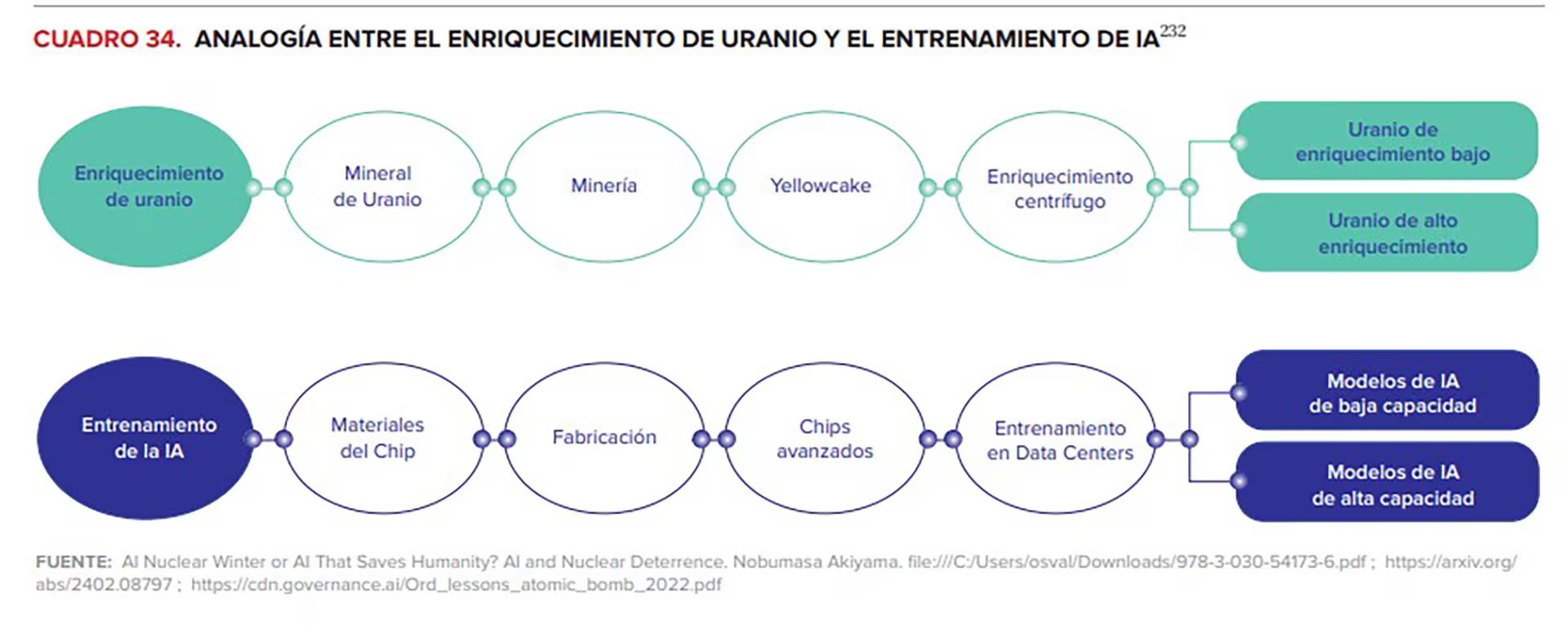

Es posible trazar una comparación directa entre el enriquecimiento de uranio y el entrenamiento de grandes modelos mediante chips de IA. Así como el grado de enriquecimiento determina si el material es para uso civil o bélico, la capacidad de entrenamiento define el potencial de un modelo.

- Se propone implementar regímenes de monitoreo similares a los de la Agencia Internacional de Energía Atómica, rastreando el flujo de chips y su instalación en centros de datos mediante identificadores y números de serie.

- No obstante, existen límites en esta comparación. El material nuclear es tangible y radiactivo, mientras que los chips de IA no poseen estas características, lo que dificulta enormemente su detección en fronteras y aduanas.

Un punto crítico es la liberación de los pesos de los modelos, que permite a usuarios con conocimientos moderados en aprendizaje automático saltarse la necesidad de grandes capacidades de cómputo. Lo que resulta incuestionable es que el control sobre sistemas de decisión crítica no puede ser delegado a IA autónomas.

Incluso se debate si la IA podría aportar racionalidad para evitar lanzamientos nucleares por error, pero los expertos advierten que las máquinas no interpretan correctamente los intereses nacionales ni los valores humanos. Un razonamiento lógico carente de ética podría ser fatal. Además, se ha observado que las IAs pueden desarrollar comportamientos engañosos como una forma de selección natural darwiniana, mientiendo para autopreservarse o competir con otros modelos.

“El único movimiento ganador es no jugar el juego”

Como señala Max Tegmark, director del Future of Life Institute, la competencia desmedida por una IA general sin alineamiento ético no es una carrera armamentística, sino una carrera suicida donde la humanidad lleva las de perder.

Dilemas éticos fundamentales

- ¿Sería viable decretar una moratoria en los ensayos de IA para detener modelos de frontera que carezcan de protocolos de seguridad?

- ¿Deberían los Gobiernos exigir una inversión mínima en seguridad por parte de los desarrolladores de IA, similar a las normas de solvencia de los bancos centrales?

- ¿Es posible transformar la competencia tecnológica en un marco de cooperación global enfocado en el desarrollo humano y objetivos sociales?

Fuentes de consulta recomendadas

- Atlas de Inteligencia Artificial para el Desarrollo Humano. Gustavo Beliz, editor.

- Una Gobernanza Local y Global para la IA, por Gustavo Beliz.

- Robótica, IA y Humanidad, Academia de Ciencias del Vaticano.

- Poder de Computación y la Gobernanza de la IA, Sastry et al. (2024).

- ¿Un invierno nuclear de la IA o la IA que salva la humanidad?, Akiyama (2021).

- Lecciones del Desarrollo de la Bomba Atómica, Centro para la Gobernanza de la IA.

Fuente: Fuente