A pesar de que el lanzamiento de Apple Intelligence no generó el impacto masivo que se proyectaba inicialmente, quedando en diversas comparativas por debajo de los sistemas de inteligencia artificial desarrollados por Google y otros competidores del sector móvil, la gigante tecnológica sostiene que su base de usuarios está adoptando estas herramientas de forma constante.

En el marco de la reciente presentación de resultados correspondientes al primer trimestre fiscal de 2026, el director ejecutivo de la firma, Tim Cook, dio a conocer que Visual Intelligence se posiciona actualmente como la funcionalidad de inteligencia artificial con mayor nivel de uso entre los propietarios de dispositivos iPhone que cuentan con el soporte técnico necesario.

“Estamos entusiasmados de ver cómo la mayoría de los usuarios con iPhone compatibles están aprovechando activamente el poder de Apple Intelligence”

Así lo manifestó Cook ante un grupo de analistas e inversores. Si bien el líder de la compañía no proporcionó estadísticas porcentuales precisas ni cifras exactas sobre la adopción de cada herramienta, enfatizó que Visual Intelligence se ha consolidado como uno de los recursos más populares dentro de la plataforma integral de Apple Intelligence.

Estas declaraciones surgen en un periodo donde Apple Intelligence ha enfrentado diversos cuestionamientos sobre su rendimiento en etapas tempranas. Desde su introducción al mercado, la tecnología de Apple ha sido evaluada de manera crítica frente a Gemini, el motor de inteligencia artificial de Google presente en el ecosistema Android, y las propuestas avanzadas de marcas como Samsung. Frente a esto, la empresa de Cupertino intenta demostrar que su sistema de IA ya ofrece utilidades prácticas y cotidianas para el consumidor final, alejándose de simples promesas técnicas.

¿Qué es y cómo funciona Visual Intelligence?

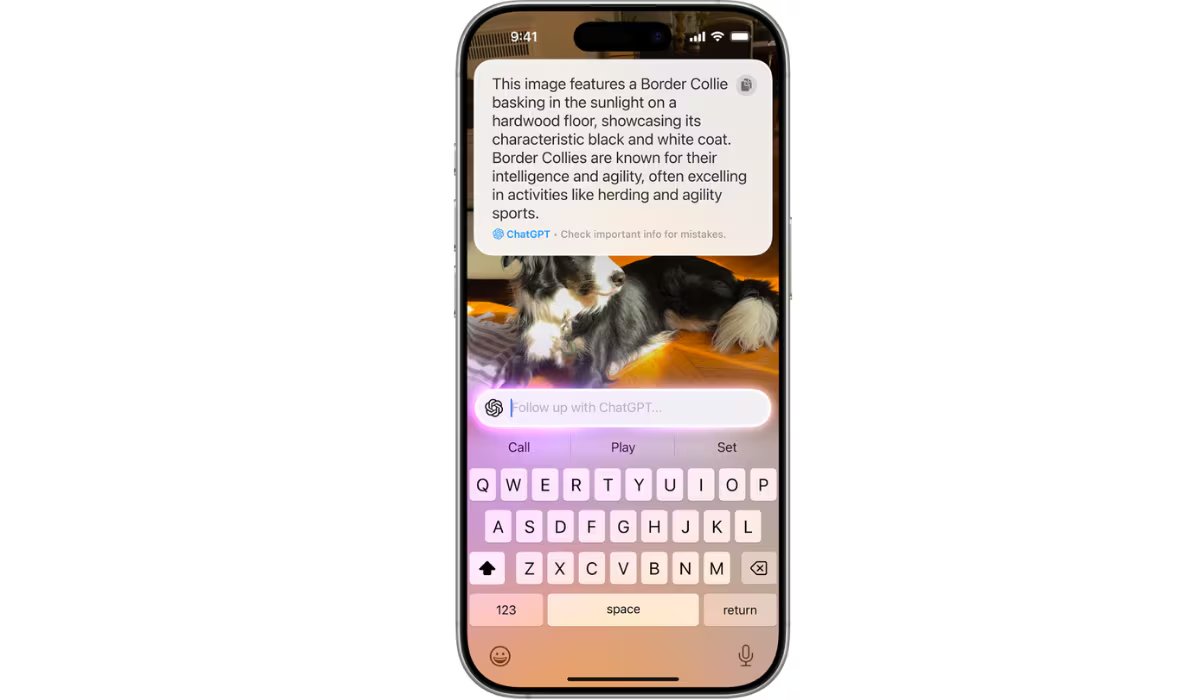

La herramienta de Visual Intelligence ha sido concebida para que las personas puedan comprender e interactuar mejor con la información que se visualiza en la pantalla de su iPhone o lo que capta el lente de su cámara en tiempo real. De acuerdo con las especificaciones de la empresa, esta utilidad optimiza las búsquedas, agiliza la ejecución de tareas y brinda respuestas basadas en el contexto, operando de manera fluida con las aplicaciones nativas del dispositivo.

Existen dos métodos principales para interactuar con esta tecnología:

- Capturas de pantalla: Al realizar un pantallazo, la interfaz despliega opciones inmediatas como “Preguntar”, “Buscar” o “Añadir al calendario”. Mediante este proceso, el usuario puede solicitar un resumen de un texto, una traducción instantánea o incluso identificar a qué producción cinematográfica pertenece un fragmento de video que esté visualizando en plataformas como TikTok.

- Uso de la cámara física: La segunda vía de acceso consiste en mantener presionado el botón de la cámara por un lapso de dos segundos. Al activarse, la función puede analizar el entorno del usuario para identificar objetos específicos, listar libros en una repisa o reconocer la raza de un perro simplemente apuntando con el smartphone.

Otras herramientas en ascenso

Durante su intervención, Tim Cook no solo se limitó a hablar de la inteligencia visual, sino que mencionó otras capacidades de Apple Intelligence que están ganando terreno. Una de ellas es Live Translation, la cual permite la traducción de audio en tiempo real a través de los AirPods, facilitando la comunicación fluida en diversos idiomas.

Del mismo modo, el directivo puso de relieve el impacto de Writing Tools, un asistente diseñado para la redacción de textos, creación de resúmenes y conversión de datos en tablas estructuradas. También se refirió a Clean Up, una utilidad de edición fotográfica que otorga la posibilidad de suprimir elementos indeseados del fondo de las imágenes con precisión digital.

A través de estos anuncios, Apple busca mitigar la idea de que su incursión en la inteligencia artificial ha sido tardía en comparación con la industria. La estrategia actual de la marca se centra en resaltar que su plataforma no es un proyecto a largo plazo, sino un conjunto de aplicaciones funcionales que ya están transformando el día a día de sus clientes.

No obstante, el panorama sigue planteando retos competitivos significativos. Persiste la incertidumbre sobre cómo se llevará a cabo la integración de Gemini dentro de los servicios de la manzana y si esta alianza será suficiente para recortar la distancia frente a la IA nativa que Google ofrece en sus terminales Pixel o la que Samsung ha implementado con éxito en su serie Galaxy.

Fuente: Fuente